Wir betrachten eine Folge von binären Zufallsgrößen mit dem Symbolvorrat {A, B} ⇒ M=2. Die Auftrittswahrscheinlichkeiten der beiden Symbole seien pA=p und pB=1−p.

Die einzelnen Folgenelemente sind statistisch unabhängig. Für die Entropie dieser Nachrichtenquelle gilt gleichermaßen:

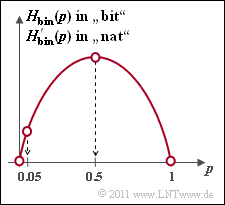

- Hbin(p)=p⋅ld1p+(1−p)⋅ld11−pin[bit],

- H′bin(p)=p⋅ln1p+(1−p)⋅ln11−pin[nat].

In diesen Gleichungen werden als Kurzbezeichnungen verwendet:

- der natürliche Logarithmus ⇒ lnp=logep,

- der Logarithmus dualis ⇒ ldp=log2p.

Die Grafik zeigt die binäre Entropiefunktion in Abhängigkeit des Parameters p, wobei 0≤p≤1 vorausgesetzt wird.

In den Teilaufgaben (5) und (6) soll der relative Fehler ermittelt werden, wenn die Symbolwahrscheinlichkeit p per Simulation (also als relative Häufigkeit h) ermittelt wurde und sich dabei fälschlicherweise h=0.9⋅p ergeben hat. Der relative Fehler ist dann wie folgt gegeben:

- εH=Hbin(h)−Hbin(p)Hbin(p).

Hinweis:

- Die Aufgabe gehört zum Kapitel Gedächtnislose Nachrichtenquellen.

Fragebogen

Musterlösung

- Die Entropiefunktion H′bin(p) lautet entsprechend der Angabe:

- H′bin(p)=p⋅ln1p+(1−p)⋅ln11−p=ln2⋅[p⋅log21p+(1−p)⋅log211−p]

- ⇒H′bin(p)(innat)=ln2⋅Hbin(p)(inbit)=0.693⋅Hbin(p).

(2) Die Optimierungsbedingung lautet dHbin(p)/dp=0 bzw.

- dH′bin(p)dp!=0⇒ddp[−p⋅lnp−(1−p)⋅ln(1−p)]!=0

- ⇒−lnp−p⋅1p+ln(1−p)+(1−p)⋅11−p!=0

- ⇒ln1−pp=0⇒1−pp=1⇒p=0.5_.

- Die Entropiewerte für p=0.5 lauten somit:

- H′bin(p=0.5)=−2⋅0.5⋅ln0.5=ln2=0.693nat,

- Hbin(p=0.5)=−2⋅0.5⋅ld0.5=log22=1bit_.

(3) Für p=5% erhält man:

- Hbin(p=0.05)=0.05⋅log210.05+0.95⋅log210.95=10.693⋅[0.05⋅ln20+0.95⋅ln1.053]≈0.286bit_.

(4) Diese Teilaufgabe lässt sich nicht in geschlossener Form lösen, sondern durch „Probieren”.

- Eine Lösung liefert das Ergebnis:

- Hbin(p=0.10)=0.469bit,Hbin(p=0.12)=0.529bit,Hbin(p=0.11)≈0.5bit⇒p1≈0.11.

- Die zweite (gesuchte) Lösung ergibt sich aus der Symmetrie von Hbin(p) zu p2=1−p1=0.89_.

(5) Mit p=0.45 erhält man Hbin(p)=0.993bit. Der relative Fehler bezüglich Entropie ist somit

- εH=Hbin(p=0.45)−Hbin(p=0.5)Hbin(p=0.5)=0.993−11=−0.7%_.

- Das Minuszeichen deutet darauf hin, dass der Entropiewert Hbin(p)=0.993bit zu klein ist.

- Hätte die Simulation den zu großen Wert p=0.55 ergeben, so wäre die Entropie und auch der relative Fehler genau so groß.

(6) Es gilt Hbin(p=0.045)=0.265bit.

- Mit dem Ergebnis der Teilaufgabe (3) ⇒ Hbin(p=0.05)=0.286bit folgt daraus für den relativen Fehler bezüglich der Entropie:

- εH=Hbin(p=0.045)−Hbin(p=0.05)Hbin(p=0.05)=0.265−0.2860.286=−7.3%_.

- Das Ergebnis zeigt:

- Eine falsche Bestimmung der Symbolwahrscheinlichkeiten um 10% macht sich für p=0.05 aufgrund des steileren Hbin(p)–Verlaufs deutlich stärker bemerkbar als für p=0.5.

- Eine zu große Wahrscheinlichkeit p=0.055 hätte zu Hbin(p=0.055)=0.307bit geführt und damit zu einer Verfälschung um εH=+7.3%. In diesem Bereich verläuft die Entropiekurve also (mit guter Näherung) linear.