Stochastische Signaltheorie/Statistische Abhängigkeit und Unabhängigkeit: Unterschied zwischen den Versionen

| (16 dazwischenliegende Versionen von 2 Benutzern werden nicht angezeigt) | |||

| Zeile 7: | Zeile 7: | ||

==Allgemeine Definition von statistischer Abhängigkeit== | ==Allgemeine Definition von statistischer Abhängigkeit== | ||

| − | Bisher haben wir die | + | <br> |

| + | Bisher haben wir die "statistische Abhängigkeit" zwischen Ereignissen nicht besonders beachtet, auch wenn wir sie wie im Fall zweier disjunkter Mengen bereits verwendet haben: Gehört ein Element zu $A$, so kann es mit Sicherheit nicht auch in der disjunkten Menge $B$ enthalten sein. | ||

| − | Die stärkste Form von Abhängigkeit überhaupt ist eine solche '''deterministische Abhängigkeit''' zwischen zwei Mengen bzw. zwei Ereignissen. Weniger ausgeprägt ist die statistische Abhängigkeit. Beginnen wir mit deren Komplement: | + | Die stärkste Form von Abhängigkeit überhaupt ist eine solche '''deterministische Abhängigkeit''' zwischen zwei Mengen bzw. zwei Ereignissen. Weniger ausgeprägt ist die statistische Abhängigkeit. Beginnen wir mit deren Komplement: |

| − | {{ | + | {{BlaueBox|TEXT= |

| − | Zwei Ereignisse $A$ und $B$ bezeichnet man dann als '''statistisch unabhängig''' (englisch: | + | $\text{Definitionen:}$ |

| − | $${\rm Pr}(A \cap B) = {\rm Pr}(A)\cdot {\rm Pr}(B).$$ | + | *Zwei Ereignisse $A$ und $B$ bezeichnet man dann als '''statistisch unabhängig''' (englisch: "statistical independent"), wenn die Wahrscheinlichkeit der Schnittmenge $A ∩ B$ gleich dem Produkt der Einzelwahrscheinlichkeiten ist: |

| − | {{ | + | :$${\rm Pr}(A \cap B) = {\rm Pr}(A)\cdot {\rm Pr}(B).$$ |

| + | *Ist diese Bedingung nicht erfüllt, so sind die Ereignisse $A$ und $B$ '''statistisch abhängig''' (englisch: "statistical dependent"): | ||

| + | :$${\rm Pr}(A \cap B) \ne {\rm Pr}(A)\cdot {\rm Pr}(B).$$}} | ||

| − | In manchen Anwendungsfällen ist die statistische Unabhängigkeit offensichtlich, zum Beispiel beim Experiment „Münzwurf”. Die Wahrscheinlichkeit für „Zahl” oder „Bild” ist unabhängig davon, ob beim letzten Wurf | + | *In manchen Anwendungsfällen ist die statistische Unabhängigkeit offensichtlich, zum Beispiel beim Experiment „Münzwurf”. Die Wahrscheinlichkeit für „Zahl” oder „Bild” ist unabhängig davon, ob beim letzten Wurf „Zahl” oder „Bild” aufgetreten ist. |

| − | Und auch die einzelnen Ergebnisse beim Zufallsexperiment „Werfen einer Roulettekugel” sind bei fairen Bedingungen stets statistisch unabhängig voneinander, auch wenn einzelne Systemspieler dies nicht wahrhaben wollen. | + | *Und auch die einzelnen Ergebnisse beim Zufallsexperiment „Werfen einer Roulettekugel” sind bei fairen Bedingungen stets statistisch unabhängig voneinander, auch wenn einzelne Systemspieler dies nicht wahrhaben wollen. |

| − | Bei anderen Anwendungen ist dagegen die Frage, ob zwei Ereignisse statistisch unabhängig sind oder nicht, gefühlsmäßig nicht oder nur sehr schwer zu beantworten. Hier kann man nur durch Überprüfung des oben angegebenen formalen Unabhängigkeitskriteriums zur richtigen Antwort | + | *Bei anderen Anwendungen ist dagegen die Frage, ob zwei Ereignisse statistisch unabhängig sind oder nicht, gefühlsmäßig nicht oder nur sehr schwer zu beantworten. Hier kann man nur durch Überprüfung des oben angegebenen formalen Unabhängigkeitskriteriums zur richtigen Antwort kommen, wie das folgende Beispiel zeigen soll. |

| − | {{Beispiel} | + | {{GraueBox|TEXT= |

| − | + | $\text{Beispiel 1:}$ | |

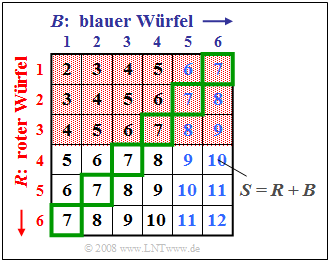

| − | Wir betrachten wieder das Zufallsexperiment „Werfen mit zwei Würfeln”, wobei die beiden Würfel an ihren Farben Rot $(R)$ und Blau $(B)$ unterschieden werden können. Die Grafik | + | Wir betrachten wieder das Zufallsexperiment „Werfen mit zwei Würfeln”, wobei die beiden Würfel an ihren Farben Rot $(R)$ und Blau $(B)$ unterschieden werden können. Die Grafik verdeutlicht diesen Sachverhalt, wobei in dem zweidimensionalen Feld $(R, B)$ die Summe $S = R + B$ eingetragen ist. |

Für die folgende Beschreibung definieren wir folgende Ereignisse: | Für die folgende Beschreibung definieren wir folgende Ereignisse: | ||

| − | *$A_1$: Die Augenzahl des roten Würfels ist $R < 4$ (rote Hinterlegung) ⇒ ${\rm Pr}(A_1) = 1/2$, | + | [[Datei:P_ID502__Sto_T_1_3_S1_neu.png|right|frame| Beispiele für statistisch unabhängige Ereignisse]] |

| − | *$A_2$: Die Augenzahl des blauen Würfels ist $B > 4$ (blaue Schrift) ⇒ ${\rm Pr}(A_2) = 1/3$, | + | *$A_1$: Die Augenzahl des roten Würfels ist $R < 4$ (rote Hinterlegung) ⇒ ${\rm Pr}(A_1) = 1/2$, |

| − | *$A_3$: Die Summe der beiden Würfel ist $S = 7$ (grüne Umrahmung) ⇒ ${\rm Pr}(A_3) = 1/6$, | + | *$A_2$: Die Augenzahl des blauen Würfels ist $B > 4$ (blaue Schrift) ⇒ ${\rm Pr}(A_2) = 1/3$, |

| − | *$A_4$: Die Summe der beiden Würfel ist $S = 8$ ⇒ ${\rm Pr}(A_4) = 5/36$, | + | *$A_3$: Die Summe der beiden Würfel ist $S = 7$ (grüne Umrahmung) ⇒ ${\rm Pr}(A_3) = 1/6$, |

| − | *$A_5$: Die Summe der beiden Würfel ist $S = 10$ ⇒ ${\rm Pr}(A_5) = 3/36$. | + | *$A_4$: Die Summe der beiden Würfel ist $S = 8$ ⇒ ${\rm Pr}(A_4) = 5/36$, |

| + | *$A_5$: Die Summe der beiden Würfel ist $S = 10$ ⇒ ${\rm Pr}(A_5) = 3/36$. | ||

Die Grafik kann wie folgt interpretiert werden: | Die Grafik kann wie folgt interpretiert werden: | ||

| − | *Die | + | *Die Ereignisse $A_1$ und $A_2$ sind statistisch unabhängig, da die Wahrscheinlichkeit ${\rm Pr}(A_1 ∩ A_2) = 1/6$ der Schnittmenge gleich dem Produkt der beiden Einzelwahrscheinlichkeiten ${\rm Pr}(A_1) = 1/2$ und ${\rm Pr}(A_2) = 1/3$ ist. Aufgrund der Aufgabenstellung hätte auch jedes andere Ergebnis sehr überrascht. |

| − | * | + | *Die Ereignisse $A_1$ und $A_3$ sind wegen ${\rm Pr}(A_1) = 1/2$, ${\rm Pr}(A_3) = 1/6$ und ${\rm Pr}(A_1 ∩ A_3) = 1/12$ ebenfalls statistisch unabhängig. Die Wahrscheinlichkeit der Schnittmenge $(1/12)$ ergibt sich, weil drei der $36$ Felder sowohl rot hinterlegt als auch grün umrandet sind. |

| − | * | + | *Zwischen $A_1$ und $A_4$ gibt es statistische Bindungen, da die Wahrscheinlichkeit der Schnittmenge ⇒ ${\rm Pr}(A_1 ∩ A_4) = 1/18 = 4/72$ ungleich dem Produkt ${\rm Pr}(A_1) \cdot {\rm Pr}(A_4)= 1/2 \cdot 5/36 = 5/72$ ist. |

| − | *Die beiden Ereignisse $A_1$ und $A_5$ sind sogar disjunkt ⇒ ${\rm Pr}(A_1 ∩ A_5) = 0$: Keines der rot hinterlegten Felder ist mit $S=10$ beschriftet. Dieses Beispiel zeigt, dass Disjunktivität eine besonders ausgeprägte Form von statistischer Abhängigkeit ist. | + | *Die beiden Ereignisse $A_1$ und $A_5$ sind sogar disjunkt ⇒ ${\rm Pr}(A_1 ∩ A_5) = 0$: Keines der rot hinterlegten Felder ist mit $S=10$ beschriftet. |

| − | + | ||

| + | |||

| + | '''Dieses Beispiel zeigt, dass Disjunktivität eine besonders ausgeprägte Form von statistischer Abhängigkeit ist'''. }} | ||

==Bedingte Wahrscheinlichkeit== | ==Bedingte Wahrscheinlichkeit== | ||

| − | Bestehen zwischen den beiden Ereignissen $A$ und $B$ statistische Bindungen, so ist durch die (unbedingten) Wahrscheinlichkeiten ${\rm Pr}(A)$ und ${\rm Pr}(B)$ der Sachverhalt im statistischen Sinne nicht eindeutig beschrieben. Man benötigt dann noch so genannte bedingte Wahrscheinlichkeiten. | + | <br> |

| + | Bestehen zwischen den beiden Ereignissen $A$ und $B$ statistische Bindungen, so ist durch die (unbedingten) Wahrscheinlichkeiten ${\rm Pr}(A)$ und ${\rm Pr}(B)$ der Sachverhalt im statistischen Sinne nicht eindeutig beschrieben. Man benötigt dann noch so genannte bedingte Wahrscheinlichkeiten. | ||

| + | |||

| + | {{BlaueBox|TEXT= | ||

| + | $\text{Definitionen:}$ | ||

| − | + | *Die '''bedingte Wahrscheinlichkeit''' (englisch: "conditional probability") von $A$ unter der Bedingung $B$ ist wie folgt berechenbar: | |

| − | Die '''bedingte Wahrscheinlichkeit''' (englisch: | + | :$${\rm Pr}(A\hspace{0.05cm} \vert \hspace{0.05cm} B) = \frac{ {\rm Pr}(A \cap B)}{ {\rm Pr}(B)}.$$ |

| − | $${\rm Pr}(A\hspace{0.05cm} | ||

| − | |||

| + | *In gleicher Weise gilt für die bedingte Wahrscheinlichkeit von $B$ unter der Bedingung $A$: | ||

| + | :$${\rm Pr}(B\hspace{0.05cm} \vert \hspace{0.05cm}A) = \frac{ {\rm Pr}(A \cap B)}{ {\rm Pr}(A)}.$$ | ||

| − | + | *Verknüpft man diese beiden Gleichungen, so ergibt sich der Satz von [https://de.wikipedia.org/wiki/Thomas_Bayes Bayes]: | |

| − | $${\rm Pr}(B\hspace{0.05cm} | + | :$${\rm Pr}(B \hspace{0.05cm} \vert \hspace{0.05cm} A) = \frac{ {\rm Pr}(A\hspace{0.05cm} \vert \hspace{0.05cm} B)\cdot {\rm Pr}(B)}{ {\rm Pr}(A)}.$$}} |

| − | |||

| − | |||

Nachfolgend sind einige Eigenschaften von bedingten Wahrscheinlichkeiten zusammengestellt: | Nachfolgend sind einige Eigenschaften von bedingten Wahrscheinlichkeiten zusammengestellt: | ||

| − | *Auch eine bedingte Wahrscheinlichkeit liegt stets zwischen $0$ und $1$ einschließlich dieser beiden Grenzen: $0 \le {\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) \le 1$. | + | *Auch eine bedingte Wahrscheinlichkeit liegt stets zwischen $0$ und $1$ einschließlich dieser beiden Grenzen: $0 \le {\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) \le 1$. |

| − | *Kann die Bedingung $B$ als konstant angesehen werden, so gelten alle im Kapitel [[Stochastische_Signaltheorie/Mengentheoretische_Grundlagen|Mengentheoretische Grundlagen]] für die unbedingten Wahrscheinlichkeiten ${\rm Pr}(A)$ und ${\rm Pr}(B)$ angegebenen Rechenregeln weiterhin. | + | *Kann die Bedingung $B$ als konstant angesehen werden, so gelten alle im Kapitel [[Stochastische_Signaltheorie/Mengentheoretische_Grundlagen|Mengentheoretische Grundlagen]] für die unbedingten Wahrscheinlichkeiten ${\rm Pr}(A)$ und ${\rm Pr}(B)$ angegebenen Rechenregeln weiterhin. |

| − | *Sind die existierenden Ereignisse $A$ und $B$ disjunkt, so ist ${\rm Pr}(A\hspace{0.05cm} | \hspace{0.05cm} B) = {\rm Pr}(B\hspace{0.05cm} | \hspace{0.05cm}A)= 0$. | + | *Sind die existierenden Ereignisse $A$ und $B$ disjunkt, so ist ${\rm Pr}(A\hspace{0.05cm} | \hspace{0.05cm} B) = {\rm Pr}(B\hspace{0.05cm} | \hspace{0.05cm}A)= 0$. |

| − | *Ist $B$ eine echte oder unechte Teilmenge von $A$, so ist ${\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) =1$. | + | *Ist $B$ eine echte oder unechte Teilmenge von $A$, so ist ${\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) =1$. |

| − | *Sind zwei Ereignisse $A$ und $B$ statistisch voneinander unabhängig, so sind deren bedingte Wahrscheinlichkeiten gleich den unbedingten, wie | + | *Sind zwei Ereignisse $A$ und $B$ statistisch voneinander unabhängig, so sind deren bedingte Wahrscheinlichkeiten gleich den unbedingten, wie folgende Rechnung zeigt: |

| − | $${\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) = \frac{{\rm Pr}(A \cap B)}{{\rm Pr}(B)} = \frac{{\rm Pr} ( A) \cdot {\rm Pr} ( B)} { {\rm Pr}(B)} = {\rm Pr} ( A).$$ | + | :$${\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) = \frac{{\rm Pr}(A \cap B)}{{\rm Pr}(B)} = \frac{{\rm Pr} ( A) \cdot {\rm Pr} ( B)} { {\rm Pr}(B)} = {\rm Pr} ( A).$$ |

| + | {{GraueBox|TEXT= | ||

| + | $\text{Beispiel 2:}$ | ||

| + | Wir betrachten wieder das Zufallsexperiment „Werfen mit zwei Würfeln”, wobei wie im [[Stochastische_Signaltheorie/Statistische_Abhängigkeit_und_Unabhängigkeit#Allgemeine_Definition_von_statistischer_Abh.C3.A4ngigkeit|$\text{Beispiel 1}$]] $S = R + B$ die Summe des roten und des blauen Würfels bezeichnet. | ||

| − | + | [[Datei:P_ID505__Sto_T_1_3_S2_neu.png |frame| Beispiel für statistisch abhängige Ereignisse|right]] | |

| − | [[Datei:P_ID505__Sto_T_1_3_S2_neu.png | Beispiel für statistisch abhängige Ereignisse|right]] | + | Wir betrachten hier die Bindungen zwischen den beiden Ereignissen |

| − | Wir betrachten | ||

| − | + | *$A_1$: Die Augenzahl des roten Würfels ist $R < 4$ (rote Hinterlegung) ⇒ ${\rm Pr}(A_1) = 1/2$, | |

| − | *$A_1$: Die Augenzahl des roten Würfels ist $R < 4$ (rote Hinterlegung) ⇒ ${\rm Pr}(A_1) = 1/2$, | + | *$A_4$: Die Summe der beiden Würfel ist $S = 8$ (grüne Umrahmung) ⇒ ${\rm Pr}(A_4) = 5/36$, |

| − | *$A_4$: Die Summe der beiden Würfel ist $S = 8$ (grüne Umrahmung) ⇒ ${\rm Pr}(A_4) = 5/36$, | ||

| − | und nehmen nochmals auf das Ereignis | + | und nehmen nochmals Bezug auf das Ereignis |

| − | *$A_3$: Die Summe der beiden Würfel ist $S = 7$ ⇒ ${\rm Pr}(A_3) = 1/6$. | + | *$A_3$: Die Summe der beiden Würfel ist $S = 7$ ⇒ ${\rm Pr}(A_3) = 1/6$. |

Zu dieser Grafik ist anzumerken: | Zu dieser Grafik ist anzumerken: | ||

| − | *Zwischen | + | *Zwischen $A_1$ und $A_4$ bestehen statistische Bindungen, da die Wahrscheinlichkeit der Schnittmenge ⇒ ${\rm Pr}(A_1 ∩ A_4) = 2/36 = 4/72$ ungleich dem Produkt ${\rm Pr}(A_1) \cdot {\rm Pr}(A_4)= 1/2 \cdot 5/36 = 5/72$ ist. |

| − | *Die bedingte Wahrscheinlichkeit ${\rm Pr}(A_1 \hspace{0.05cm} | + | *Die bedingte Wahrscheinlichkeit ${\rm Pr}(A_1 \hspace{0.05cm} \vert \hspace{0.05cm} A_4) = 2/5$ kann aus dem Quotienten der Verbundwahrscheinlichkeit ${\rm Pr}(A_1 ∩ A_4) = 2/36$ und der Wahrscheinlichkeit ${\rm Pr}(A_4) = 5/36$ berechnet werden. |

| − | *Da $A_1$ und $A_4$ statistisch abhängig sind, ist die bedingte Wahrscheinlichkeit ${\rm Pr}(A_1 \hspace{0.05cm} | + | *Da $A_1$ und $A_4$ statistisch abhängig sind, ist die bedingte Wahrscheinlichkeit ${\rm Pr}(A_1 \hspace{0.05cm}\vert \hspace{0.05cm} A_4) = 2/5$ (zwei der fünf grün umrandeten Felder sind rot hinterlegt) ungleich der absoluten Wahrscheinlichkeit ${\rm Pr}(A_1) = 1/2$ (die Hälfte aller Felder sind rot hinterlegt). |

| − | *Ebenso ist die bedingte Wahrscheinlichkeit ${\rm Pr}(A_4 \hspace{0.05cm} | + | *Ebenso ist die bedingte Wahrscheinlichkeit ${\rm Pr}(A_4 \hspace{0.05cm} \vert \hspace{0.05cm} A_1) = 2/18 = 4/36$ (zwei der $18$ rot hinterlegten Felder sind grün umrandet) ungleich der absoluten Wahrscheinlichkeit ${\rm Pr}(A_4) = 5/36$ (insgesamt sind fünf der $36$ Felder grün umrandet). |

| − | *Dieses letzte Ergebnis lässt sich zum Beispiel auch über den Satz von Bayes ableiten: | + | *Dieses letzte Ergebnis lässt sich zum Beispiel auch über den '''Satz von Bayes''' ableiten: |

| − | :$${\rm Pr}(A_4 \hspace{0.05cm} | + | :$${\rm Pr}(A_4 \hspace{0.05cm} \vert\hspace{0.05cm} A_1) = \frac{ {\rm Pr}(A_1 \hspace{0.05cm} \vert\hspace{0.05cm} A_4)\cdot {\rm Pr} ( A_4)} { {\rm Pr}(A_1)} = \frac{2/5 \cdot 5/36}{1/2} = 1/9.$$ |

| − | *Dagegen gelten für $A_1$ und das hierzu statistisch unabhängige Ereignis $A_3$ die folgenden bedingten Wahrscheinlichkeiten, siehe [[Stochastische_Signaltheorie/Statistische_Abhängigkeit_und_Unabhängigkeit#Allgemeine_Definition_von_statistischer_Abh.C3. | + | *Dagegen gelten für $A_1$ und das hierzu statistisch unabhängige Ereignis $A_3$ die folgenden bedingten Wahrscheinlichkeiten, siehe [[Stochastische_Signaltheorie/Statistische_Abhängigkeit_und_Unabhängigkeit#Allgemeine_Definition_von_statistischer_Abh.C3.A4ngigkeit| Beispiel 1]]: |

| − | :$${\rm Pr} | + | :$${\rm Pr}(A_{\rm 1} \hspace{0.05cm}\vert \hspace{0.05cm} A_{\rm 3}) = {\rm Pr}(A_{\rm 1}) = \rm 1/2\hspace{0.5cm}{\rm bzw.}\hspace{0.5cm}{\rm Pr}(A_{\rm 3} \hspace{0.05cm} \vert \hspace{0.05cm} A_{\rm 1}) = {\rm Pr}(A_{\rm 3}) = 1/6.$$}} |

| − | |||

==Allgemeines Multiplikationstheorem== | ==Allgemeines Multiplikationstheorem== | ||

| − | Wir betrachten | + | <br> |

| + | Wir betrachten mehrere Ereignisse, die als $A_i$ mit $1 ≤ i ≤ I$ bezeichnet werden. Diese Ereignisse $A_i$ stellen nun aber kein [[Stochastische_Signaltheorie/Mengentheoretische_Grundlagen#Vollst.C3.A4ndiges_System|vollständiges System]] mehr dar, das heißt, | ||

| + | *sie sind nicht paarweise zueinander disjunkt, und | ||

| + | *es können zwischen den einzelnen Ereignissen auch statistische Bindungen bestehen. | ||

| − | |||

| − | |||

| − | |||

| − | |||

| − | |||

| + | {{BlaueBox|TEXT= | ||

| + | $\text{Definition:}$ | ||

| + | Für die so genannte '''Verbundwahrscheinlichkeit''', also für die Wahrscheinlichkeit der Schnittmenge aller $I$ Ereignisse $A_i$, gilt in diesem Fall: | ||

| + | :$${\rm Pr}(A_{\rm 1} \cap \hspace{0.02cm}\text{ ...}\hspace{0.1cm} \cap A_{I}) = | ||

| + | {\rm Pr}(A_{I})\hspace{0.05cm}\cdot\hspace{0.05cm}{\rm Pr}(A_{I \rm -1} \hspace{0.05cm}\vert \hspace{0.05cm} A_I) \hspace{0.05cm}\cdot \hspace{0.05cm}{\rm Pr}(A_{I \rm -2} \hspace{0.05cm}\vert\hspace{0.05cm} A_{I - \rm 1}\cap A_I)\hspace{0.05cm} \cdot \hspace{0.02cm}\text{ ...} \hspace{0.1cm} \cdot\hspace{0.05cm} {\rm Pr}(A_{\rm 1} \hspace{0.05cm}\vert \hspace{0.05cm}A_{\rm 2} \cap \hspace{0.02cm}\text{ ...} \hspace{0.1cm}\cap A_{ I}).$$ | ||

In gleicher Weise gilt natürlich auch: | In gleicher Weise gilt natürlich auch: | ||

| − | $$\rm Pr( | + | :$${\rm Pr}(A_{\rm 1} \cap \hspace{0.02cm}\text{ ...}\hspace{0.1cm} \cap A_{I}) = {\rm Pr}(A_1)\hspace{0.05cm}\cdot\hspace{0.05cm}{\rm Pr}(A_2 \hspace{0.05cm}\vert \hspace{0.05cm} A_1) \hspace{0.05cm}\cdot \hspace{0.05cm}{\rm Pr}(A_3 \hspace{0.05cm}\vert \hspace{0.05cm} A_1\cap A_2)\hspace{0.05cm} \cdot \hspace{0.02cm}\text{ ...}\hspace{0.1cm} \cdot\hspace{0.05cm} {\rm Pr}(A_I \hspace{0.05cm}\vert \hspace{0.05cm}A_1 \cap \hspace{0.02cm} \text{ ...} \hspace{0.1cm}\cap A_{ I-1}).$$}} |

| − | + | ||

| − | {{Beispiel} | + | {{GraueBox|TEXT= |

| − | Eine Lostrommel enthält zehn Lose, darunter drei Treffer (Ereignis $ | + | $\text{Beispiel 3:}$ |

| − | + | Eine Lostrommel enthält zehn Lose, darunter drei Treffer $($Ereignis $T_1)$. | |

| + | *Dann gilt für die Wahrscheinlichkeit, dass man mit zwei Losen zwei Treffer zieht: | ||

| − | + | :$${\rm Pr}(T_1 \cap T_2) = {\rm Pr}(T_1) \cdot {\rm Pr}(T_2 \hspace{0.05cm }\vert \hspace{0.05cm} T_1) = 3/10 \cdot 2/9 = 1/15 \approx 6.7 \%.$$ | |

| − | Würde man jedoch die Lose nach der Ziehung wieder in die Trommel zurücklegen, so wären die Ereignisse $T_1$ und $T_2$ statistisch unabhängig | + | *Hierbei ist berücksichtigt, dass sich bei der zweiten Ziehung $($Ereignis $T_2)$ nur mehr neun Lose und zwei Treffer in der Urne befänden, falls im ersten Durchgang ein Treffer gezogen worden ist: |

| − | + | :$${\rm Pr}(T_2 \hspace{0.05cm} \vert\hspace{0.05cm} T_1) = 2/9\approx 22.2 \%.$$ | |

| + | *Würde man jedoch die Lose nach der Ziehung wieder in die Trommel zurücklegen, so wären die Ereignisse $T_1$ und $T_2$ statistisch unabhängig und es würde gelten: | ||

| + | :$$ {\rm Pr}(T_1 ∩ T_2) = (3/10)^2 = 9\%.$$}} | ||

==Rückschlusswahrscheinlichkeit== | ==Rückschlusswahrscheinlichkeit== | ||

| − | Gegeben seien Ereignisse $A_i$ mit 1 ≤ | + | <br> |

| − | $$\rm \bigcup_{\it i=1}^{\it I}\it A_i = \it G.$$ | + | Gegeben seien wieder Ereignisse $A_i$ mit $1 ≤ i ≤ I$, die ein [[Stochastische_Signaltheorie/Mengentheoretische_Grundlagen#Vollst.C3.A4ndiges_System|vollständiges System]] bilden. Das heißt: |

| + | *Alle Ereignisse sind paarweise disjunkt $(A_i ∩ A_j = ϕ$ für alle $i ≠ j$ ). | ||

| + | *Die Vereinigungsmenge ergibt die Grundmenge: | ||

| + | :$$\rm \bigcup_{\it i=1}^{\it I}\it A_i = \it G.$$ | ||

| − | Daneben betrachten wir noch das Ereignis $B$, von dem alle bedingten Wahrscheinlichkeiten Pr( | + | Daneben betrachten wir noch das Ereignis $B$, von dem alle bedingten Wahrscheinlichkeiten ${\rm Pr}(B \hspace{0.05cm} | \hspace{0.05cm} A_i)$ mit den Indizes $1 ≤ i ≤ I$ bekannt sind. |

| − | {{ | + | {{BlaueBox|TEXT= |

| − | + | $\text{Satz von der totalen Wahrscheinlichkeit:}$ | |

| − | |||

| − | |||

| + | Unter den oben genannten Voraussetzungen gilt für die (unbedingte) Wahrscheinlichkeit des Ereignisses $B$: | ||

| + | :$${\rm Pr}(B) = \sum_{i={\rm1} }^{I}{\rm Pr}(B \cap A_i) = \sum_{i={\rm1} }^{I}{\rm Pr}(B \hspace{0.05cm} \vert\hspace{0.05cm} A_i)\cdot{\rm Pr}(A_i).$$}} | ||

| − | |||

| − | |||

| − | {{ | + | {{BlaueBox|TEXT= |

| − | + | $\text{Definition:}$ | |

| − | |||

| − | |||

| − | $ | ||

| − | |||

| − | |||

| − | == | + | Aus dieser Gleichung folgt mit dem [[Stochastische_Signaltheorie/Statistische_Abhängigkeit_und_Unabhängigkeit#Bedingte_Wahrscheinlichkeit|Satz von Bayes]] für die '''Rückschlusswahrscheinlichkeit''': |

| + | :$${\rm Pr}(A_i \hspace{0.05cm} \vert \hspace{0.05cm} B) = \frac{ {\rm Pr}( B \mid A_i)\cdot {\rm Pr}(A_i )}{ {\rm Pr}(B)} = \frac{ {\rm Pr}(B \hspace{0.05cm} \vert \hspace{0.05cm} A_i)\cdot {\rm Pr}(A_i )}{\sum_{k={\rm1} }^{I}{\rm Pr}(B \hspace{0.05cm} \vert \hspace{0.05cm} A_k)\cdot{\rm Pr}(A_k) }.$$}} | ||

| + | |||

| + | |||

| + | {{GraueBox|TEXT= | ||

| + | $\text{Beispiel 4:}$ | ||

| + | In Münchner Studentenheimen wohnen Studierende | ||

| + | *der Ludwig–Maximilian–Universität $($Ereignis $L$ ⇒ ${\rm Pr}(L) = 70\%)$ und | ||

| + | *der Technischen Universität München $($Ereignis $T$ ⇒ ${\rm Pr}(T) = 30\%)$. | ||

| + | |||

| + | |||

| + | Es ist weiterhin bekannt, dass an der LMU $60\%$ aller Studierenden weiblich sind, an der TUM nur $10\%$. | ||

| + | |||

| + | *Der Anteil aller Studentinnen im Studentenheim $($Ereignis $W)$ kann dann mit dem Satz von der totalen Wahrscheinlichkeit ermittelt werden: | ||

| + | :$${\rm Pr}(W) = {\rm Pr}(W \hspace{0.05cm} \vert \hspace{0.05cm} L)\hspace{0.01cm}\cdot\hspace{0.01cm}{\rm Pr}(L) \hspace{0.05cm}+\hspace{0.05cm} {\rm Pr}(W \hspace{0.05cm} \vert \hspace{0.05cm} T)\hspace{0.01cm}\cdot\hspace{0.01cm}{\rm Pr}(T) = \rm 0.6\hspace{0.01cm}\cdot\hspace{0.01cm}0.7\hspace{0.05cm}+\hspace{0.05cm}0.1\hspace{0.01cm}\cdot \hspace{0.01cm}0.3 = 45 \%.$$ | ||

| + | *Trifft man eine Studentin, so kann man mit der Rückschlusswahrscheinlichkeit | ||

| + | :$${\rm Pr}(L \hspace{-0.05cm}\mid \hspace{-0.05cm}W) = \frac{ {\rm Pr}(W \hspace{-0.05cm}\mid \hspace{-0.05cm}L)\cdot {\rm Pr}(L) }{ {\rm Pr}(W \hspace{-0.05cm}\mid \hspace{-0.05cm}L) \cdot {\rm Pr}(L) +{\rm Pr}(W \hspace{-0.05cm}\mid \hspace{-0.05cm}T) \cdot {\rm Pr}(T)}=\rm \frac{0.6\cdot 0.7}{0.6\cdot 0.7 + 0.1\cdot 0.3}=\frac{14}{15}\approx 93.3 \%$$ | ||

| + | :vorhersagen, dass sie an der LMU studieren wird. Ein durchaus realistisches Ergebnis (zumindest in der Vergangenheit).}} | ||

| − | |||

| − | [[ | + | Die Aussagen dieses Abschnitts sind im Lernvideo [[Statistische_Abhängigkeit_und_Unabhängigkeit_(Lernvideo)|Statistische Abhängigkeit und Unabhängigkeit]] zusammengefasst. |

| − | [[Aufgaben:1. | + | ==Aufgaben zum Kapitel== |

| + | <br> | ||

| + | [[Aufgaben:1.4_2S/3E-Kanalmodell|Aufgabe 1.4: 2S/3E-Kanalmodell]] | ||

| − | [[Aufgaben:1. | + | [[Aufgaben:1.4Z_Summe von Ternärgrößen|Aufgabe 1.4Z: Summe von Ternärgrößen]] |

| + | [[Aufgaben:1.5 Karten ziehen|Aufgabe 1.5: Karten ziehen]] | ||

| − | + | [[Aufgaben:1.5Z_Ausfallwahrscheinlichkeiten|Aufgabe 1.5Z: Ausfallwahrscheinlichkeiten]] | |

| − | |||

{{Display}} | {{Display}} | ||

Aktuelle Version vom 30. November 2021, 15:54 Uhr

Inhaltsverzeichnis

Allgemeine Definition von statistischer Abhängigkeit

Bisher haben wir die "statistische Abhängigkeit" zwischen Ereignissen nicht besonders beachtet, auch wenn wir sie wie im Fall zweier disjunkter Mengen bereits verwendet haben: Gehört ein Element zu $A$, so kann es mit Sicherheit nicht auch in der disjunkten Menge $B$ enthalten sein.

Die stärkste Form von Abhängigkeit überhaupt ist eine solche deterministische Abhängigkeit zwischen zwei Mengen bzw. zwei Ereignissen. Weniger ausgeprägt ist die statistische Abhängigkeit. Beginnen wir mit deren Komplement:

$\text{Definitionen:}$

- Zwei Ereignisse $A$ und $B$ bezeichnet man dann als statistisch unabhängig (englisch: "statistical independent"), wenn die Wahrscheinlichkeit der Schnittmenge $A ∩ B$ gleich dem Produkt der Einzelwahrscheinlichkeiten ist:

- $${\rm Pr}(A \cap B) = {\rm Pr}(A)\cdot {\rm Pr}(B).$$

- Ist diese Bedingung nicht erfüllt, so sind die Ereignisse $A$ und $B$ statistisch abhängig (englisch: "statistical dependent"):

- $${\rm Pr}(A \cap B) \ne {\rm Pr}(A)\cdot {\rm Pr}(B).$$

- In manchen Anwendungsfällen ist die statistische Unabhängigkeit offensichtlich, zum Beispiel beim Experiment „Münzwurf”. Die Wahrscheinlichkeit für „Zahl” oder „Bild” ist unabhängig davon, ob beim letzten Wurf „Zahl” oder „Bild” aufgetreten ist.

- Und auch die einzelnen Ergebnisse beim Zufallsexperiment „Werfen einer Roulettekugel” sind bei fairen Bedingungen stets statistisch unabhängig voneinander, auch wenn einzelne Systemspieler dies nicht wahrhaben wollen.

- Bei anderen Anwendungen ist dagegen die Frage, ob zwei Ereignisse statistisch unabhängig sind oder nicht, gefühlsmäßig nicht oder nur sehr schwer zu beantworten. Hier kann man nur durch Überprüfung des oben angegebenen formalen Unabhängigkeitskriteriums zur richtigen Antwort kommen, wie das folgende Beispiel zeigen soll.

$\text{Beispiel 1:}$ Wir betrachten wieder das Zufallsexperiment „Werfen mit zwei Würfeln”, wobei die beiden Würfel an ihren Farben Rot $(R)$ und Blau $(B)$ unterschieden werden können. Die Grafik verdeutlicht diesen Sachverhalt, wobei in dem zweidimensionalen Feld $(R, B)$ die Summe $S = R + B$ eingetragen ist.

Für die folgende Beschreibung definieren wir folgende Ereignisse:

- $A_1$: Die Augenzahl des roten Würfels ist $R < 4$ (rote Hinterlegung) ⇒ ${\rm Pr}(A_1) = 1/2$,

- $A_2$: Die Augenzahl des blauen Würfels ist $B > 4$ (blaue Schrift) ⇒ ${\rm Pr}(A_2) = 1/3$,

- $A_3$: Die Summe der beiden Würfel ist $S = 7$ (grüne Umrahmung) ⇒ ${\rm Pr}(A_3) = 1/6$,

- $A_4$: Die Summe der beiden Würfel ist $S = 8$ ⇒ ${\rm Pr}(A_4) = 5/36$,

- $A_5$: Die Summe der beiden Würfel ist $S = 10$ ⇒ ${\rm Pr}(A_5) = 3/36$.

Die Grafik kann wie folgt interpretiert werden:

- Die Ereignisse $A_1$ und $A_2$ sind statistisch unabhängig, da die Wahrscheinlichkeit ${\rm Pr}(A_1 ∩ A_2) = 1/6$ der Schnittmenge gleich dem Produkt der beiden Einzelwahrscheinlichkeiten ${\rm Pr}(A_1) = 1/2$ und ${\rm Pr}(A_2) = 1/3$ ist. Aufgrund der Aufgabenstellung hätte auch jedes andere Ergebnis sehr überrascht.

- Die Ereignisse $A_1$ und $A_3$ sind wegen ${\rm Pr}(A_1) = 1/2$, ${\rm Pr}(A_3) = 1/6$ und ${\rm Pr}(A_1 ∩ A_3) = 1/12$ ebenfalls statistisch unabhängig. Die Wahrscheinlichkeit der Schnittmenge $(1/12)$ ergibt sich, weil drei der $36$ Felder sowohl rot hinterlegt als auch grün umrandet sind.

- Zwischen $A_1$ und $A_4$ gibt es statistische Bindungen, da die Wahrscheinlichkeit der Schnittmenge ⇒ ${\rm Pr}(A_1 ∩ A_4) = 1/18 = 4/72$ ungleich dem Produkt ${\rm Pr}(A_1) \cdot {\rm Pr}(A_4)= 1/2 \cdot 5/36 = 5/72$ ist.

- Die beiden Ereignisse $A_1$ und $A_5$ sind sogar disjunkt ⇒ ${\rm Pr}(A_1 ∩ A_5) = 0$: Keines der rot hinterlegten Felder ist mit $S=10$ beschriftet.

Dieses Beispiel zeigt, dass Disjunktivität eine besonders ausgeprägte Form von statistischer Abhängigkeit ist.

Bedingte Wahrscheinlichkeit

Bestehen zwischen den beiden Ereignissen $A$ und $B$ statistische Bindungen, so ist durch die (unbedingten) Wahrscheinlichkeiten ${\rm Pr}(A)$ und ${\rm Pr}(B)$ der Sachverhalt im statistischen Sinne nicht eindeutig beschrieben. Man benötigt dann noch so genannte bedingte Wahrscheinlichkeiten.

$\text{Definitionen:}$

- Die bedingte Wahrscheinlichkeit (englisch: "conditional probability") von $A$ unter der Bedingung $B$ ist wie folgt berechenbar:

- $${\rm Pr}(A\hspace{0.05cm} \vert \hspace{0.05cm} B) = \frac{ {\rm Pr}(A \cap B)}{ {\rm Pr}(B)}.$$

- In gleicher Weise gilt für die bedingte Wahrscheinlichkeit von $B$ unter der Bedingung $A$:

- $${\rm Pr}(B\hspace{0.05cm} \vert \hspace{0.05cm}A) = \frac{ {\rm Pr}(A \cap B)}{ {\rm Pr}(A)}.$$

- Verknüpft man diese beiden Gleichungen, so ergibt sich der Satz von Bayes:

- $${\rm Pr}(B \hspace{0.05cm} \vert \hspace{0.05cm} A) = \frac{ {\rm Pr}(A\hspace{0.05cm} \vert \hspace{0.05cm} B)\cdot {\rm Pr}(B)}{ {\rm Pr}(A)}.$$

Nachfolgend sind einige Eigenschaften von bedingten Wahrscheinlichkeiten zusammengestellt:

- Auch eine bedingte Wahrscheinlichkeit liegt stets zwischen $0$ und $1$ einschließlich dieser beiden Grenzen: $0 \le {\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) \le 1$.

- Kann die Bedingung $B$ als konstant angesehen werden, so gelten alle im Kapitel Mengentheoretische Grundlagen für die unbedingten Wahrscheinlichkeiten ${\rm Pr}(A)$ und ${\rm Pr}(B)$ angegebenen Rechenregeln weiterhin.

- Sind die existierenden Ereignisse $A$ und $B$ disjunkt, so ist ${\rm Pr}(A\hspace{0.05cm} | \hspace{0.05cm} B) = {\rm Pr}(B\hspace{0.05cm} | \hspace{0.05cm}A)= 0$.

- Ist $B$ eine echte oder unechte Teilmenge von $A$, so ist ${\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) =1$.

- Sind zwei Ereignisse $A$ und $B$ statistisch voneinander unabhängig, so sind deren bedingte Wahrscheinlichkeiten gleich den unbedingten, wie folgende Rechnung zeigt:

- $${\rm Pr}(A \hspace{0.05cm} | \hspace{0.05cm} B) = \frac{{\rm Pr}(A \cap B)}{{\rm Pr}(B)} = \frac{{\rm Pr} ( A) \cdot {\rm Pr} ( B)} { {\rm Pr}(B)} = {\rm Pr} ( A).$$

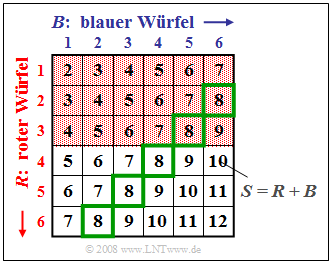

$\text{Beispiel 2:}$ Wir betrachten wieder das Zufallsexperiment „Werfen mit zwei Würfeln”, wobei wie im $\text{Beispiel 1}$ $S = R + B$ die Summe des roten und des blauen Würfels bezeichnet.

Wir betrachten hier die Bindungen zwischen den beiden Ereignissen

- $A_1$: Die Augenzahl des roten Würfels ist $R < 4$ (rote Hinterlegung) ⇒ ${\rm Pr}(A_1) = 1/2$,

- $A_4$: Die Summe der beiden Würfel ist $S = 8$ (grüne Umrahmung) ⇒ ${\rm Pr}(A_4) = 5/36$,

und nehmen nochmals Bezug auf das Ereignis

- $A_3$: Die Summe der beiden Würfel ist $S = 7$ ⇒ ${\rm Pr}(A_3) = 1/6$.

Zu dieser Grafik ist anzumerken:

- Zwischen $A_1$ und $A_4$ bestehen statistische Bindungen, da die Wahrscheinlichkeit der Schnittmenge ⇒ ${\rm Pr}(A_1 ∩ A_4) = 2/36 = 4/72$ ungleich dem Produkt ${\rm Pr}(A_1) \cdot {\rm Pr}(A_4)= 1/2 \cdot 5/36 = 5/72$ ist.

- Die bedingte Wahrscheinlichkeit ${\rm Pr}(A_1 \hspace{0.05cm} \vert \hspace{0.05cm} A_4) = 2/5$ kann aus dem Quotienten der Verbundwahrscheinlichkeit ${\rm Pr}(A_1 ∩ A_4) = 2/36$ und der Wahrscheinlichkeit ${\rm Pr}(A_4) = 5/36$ berechnet werden.

- Da $A_1$ und $A_4$ statistisch abhängig sind, ist die bedingte Wahrscheinlichkeit ${\rm Pr}(A_1 \hspace{0.05cm}\vert \hspace{0.05cm} A_4) = 2/5$ (zwei der fünf grün umrandeten Felder sind rot hinterlegt) ungleich der absoluten Wahrscheinlichkeit ${\rm Pr}(A_1) = 1/2$ (die Hälfte aller Felder sind rot hinterlegt).

- Ebenso ist die bedingte Wahrscheinlichkeit ${\rm Pr}(A_4 \hspace{0.05cm} \vert \hspace{0.05cm} A_1) = 2/18 = 4/36$ (zwei der $18$ rot hinterlegten Felder sind grün umrandet) ungleich der absoluten Wahrscheinlichkeit ${\rm Pr}(A_4) = 5/36$ (insgesamt sind fünf der $36$ Felder grün umrandet).

- Dieses letzte Ergebnis lässt sich zum Beispiel auch über den Satz von Bayes ableiten:

- $${\rm Pr}(A_4 \hspace{0.05cm} \vert\hspace{0.05cm} A_1) = \frac{ {\rm Pr}(A_1 \hspace{0.05cm} \vert\hspace{0.05cm} A_4)\cdot {\rm Pr} ( A_4)} { {\rm Pr}(A_1)} = \frac{2/5 \cdot 5/36}{1/2} = 1/9.$$

- Dagegen gelten für $A_1$ und das hierzu statistisch unabhängige Ereignis $A_3$ die folgenden bedingten Wahrscheinlichkeiten, siehe Beispiel 1:

- $${\rm Pr}(A_{\rm 1} \hspace{0.05cm}\vert \hspace{0.05cm} A_{\rm 3}) = {\rm Pr}(A_{\rm 1}) = \rm 1/2\hspace{0.5cm}{\rm bzw.}\hspace{0.5cm}{\rm Pr}(A_{\rm 3} \hspace{0.05cm} \vert \hspace{0.05cm} A_{\rm 1}) = {\rm Pr}(A_{\rm 3}) = 1/6.$$

Allgemeines Multiplikationstheorem

Wir betrachten mehrere Ereignisse, die als $A_i$ mit $1 ≤ i ≤ I$ bezeichnet werden. Diese Ereignisse $A_i$ stellen nun aber kein vollständiges System mehr dar, das heißt,

- sie sind nicht paarweise zueinander disjunkt, und

- es können zwischen den einzelnen Ereignissen auch statistische Bindungen bestehen.

$\text{Definition:}$ Für die so genannte Verbundwahrscheinlichkeit, also für die Wahrscheinlichkeit der Schnittmenge aller $I$ Ereignisse $A_i$, gilt in diesem Fall:

- $${\rm Pr}(A_{\rm 1} \cap \hspace{0.02cm}\text{ ...}\hspace{0.1cm} \cap A_{I}) = {\rm Pr}(A_{I})\hspace{0.05cm}\cdot\hspace{0.05cm}{\rm Pr}(A_{I \rm -1} \hspace{0.05cm}\vert \hspace{0.05cm} A_I) \hspace{0.05cm}\cdot \hspace{0.05cm}{\rm Pr}(A_{I \rm -2} \hspace{0.05cm}\vert\hspace{0.05cm} A_{I - \rm 1}\cap A_I)\hspace{0.05cm} \cdot \hspace{0.02cm}\text{ ...} \hspace{0.1cm} \cdot\hspace{0.05cm} {\rm Pr}(A_{\rm 1} \hspace{0.05cm}\vert \hspace{0.05cm}A_{\rm 2} \cap \hspace{0.02cm}\text{ ...} \hspace{0.1cm}\cap A_{ I}).$$

In gleicher Weise gilt natürlich auch:

- $${\rm Pr}(A_{\rm 1} \cap \hspace{0.02cm}\text{ ...}\hspace{0.1cm} \cap A_{I}) = {\rm Pr}(A_1)\hspace{0.05cm}\cdot\hspace{0.05cm}{\rm Pr}(A_2 \hspace{0.05cm}\vert \hspace{0.05cm} A_1) \hspace{0.05cm}\cdot \hspace{0.05cm}{\rm Pr}(A_3 \hspace{0.05cm}\vert \hspace{0.05cm} A_1\cap A_2)\hspace{0.05cm} \cdot \hspace{0.02cm}\text{ ...}\hspace{0.1cm} \cdot\hspace{0.05cm} {\rm Pr}(A_I \hspace{0.05cm}\vert \hspace{0.05cm}A_1 \cap \hspace{0.02cm} \text{ ...} \hspace{0.1cm}\cap A_{ I-1}).$$

$\text{Beispiel 3:}$ Eine Lostrommel enthält zehn Lose, darunter drei Treffer $($Ereignis $T_1)$.

- Dann gilt für die Wahrscheinlichkeit, dass man mit zwei Losen zwei Treffer zieht:

- $${\rm Pr}(T_1 \cap T_2) = {\rm Pr}(T_1) \cdot {\rm Pr}(T_2 \hspace{0.05cm }\vert \hspace{0.05cm} T_1) = 3/10 \cdot 2/9 = 1/15 \approx 6.7 \%.$$

- Hierbei ist berücksichtigt, dass sich bei der zweiten Ziehung $($Ereignis $T_2)$ nur mehr neun Lose und zwei Treffer in der Urne befänden, falls im ersten Durchgang ein Treffer gezogen worden ist:

- $${\rm Pr}(T_2 \hspace{0.05cm} \vert\hspace{0.05cm} T_1) = 2/9\approx 22.2 \%.$$

- Würde man jedoch die Lose nach der Ziehung wieder in die Trommel zurücklegen, so wären die Ereignisse $T_1$ und $T_2$ statistisch unabhängig und es würde gelten:

- $$ {\rm Pr}(T_1 ∩ T_2) = (3/10)^2 = 9\%.$$

Rückschlusswahrscheinlichkeit

Gegeben seien wieder Ereignisse $A_i$ mit $1 ≤ i ≤ I$, die ein vollständiges System bilden. Das heißt:

- Alle Ereignisse sind paarweise disjunkt $(A_i ∩ A_j = ϕ$ für alle $i ≠ j$ ).

- Die Vereinigungsmenge ergibt die Grundmenge:

- $$\rm \bigcup_{\it i=1}^{\it I}\it A_i = \it G.$$

Daneben betrachten wir noch das Ereignis $B$, von dem alle bedingten Wahrscheinlichkeiten ${\rm Pr}(B \hspace{0.05cm} | \hspace{0.05cm} A_i)$ mit den Indizes $1 ≤ i ≤ I$ bekannt sind.

$\text{Satz von der totalen Wahrscheinlichkeit:}$

Unter den oben genannten Voraussetzungen gilt für die (unbedingte) Wahrscheinlichkeit des Ereignisses $B$:

- $${\rm Pr}(B) = \sum_{i={\rm1} }^{I}{\rm Pr}(B \cap A_i) = \sum_{i={\rm1} }^{I}{\rm Pr}(B \hspace{0.05cm} \vert\hspace{0.05cm} A_i)\cdot{\rm Pr}(A_i).$$

$\text{Definition:}$

Aus dieser Gleichung folgt mit dem Satz von Bayes für die Rückschlusswahrscheinlichkeit:

- $${\rm Pr}(A_i \hspace{0.05cm} \vert \hspace{0.05cm} B) = \frac{ {\rm Pr}( B \mid A_i)\cdot {\rm Pr}(A_i )}{ {\rm Pr}(B)} = \frac{ {\rm Pr}(B \hspace{0.05cm} \vert \hspace{0.05cm} A_i)\cdot {\rm Pr}(A_i )}{\sum_{k={\rm1} }^{I}{\rm Pr}(B \hspace{0.05cm} \vert \hspace{0.05cm} A_k)\cdot{\rm Pr}(A_k) }.$$

$\text{Beispiel 4:}$ In Münchner Studentenheimen wohnen Studierende

- der Ludwig–Maximilian–Universität $($Ereignis $L$ ⇒ ${\rm Pr}(L) = 70\%)$ und

- der Technischen Universität München $($Ereignis $T$ ⇒ ${\rm Pr}(T) = 30\%)$.

Es ist weiterhin bekannt, dass an der LMU $60\%$ aller Studierenden weiblich sind, an der TUM nur $10\%$.

- Der Anteil aller Studentinnen im Studentenheim $($Ereignis $W)$ kann dann mit dem Satz von der totalen Wahrscheinlichkeit ermittelt werden:

- $${\rm Pr}(W) = {\rm Pr}(W \hspace{0.05cm} \vert \hspace{0.05cm} L)\hspace{0.01cm}\cdot\hspace{0.01cm}{\rm Pr}(L) \hspace{0.05cm}+\hspace{0.05cm} {\rm Pr}(W \hspace{0.05cm} \vert \hspace{0.05cm} T)\hspace{0.01cm}\cdot\hspace{0.01cm}{\rm Pr}(T) = \rm 0.6\hspace{0.01cm}\cdot\hspace{0.01cm}0.7\hspace{0.05cm}+\hspace{0.05cm}0.1\hspace{0.01cm}\cdot \hspace{0.01cm}0.3 = 45 \%.$$

- Trifft man eine Studentin, so kann man mit der Rückschlusswahrscheinlichkeit

- $${\rm Pr}(L \hspace{-0.05cm}\mid \hspace{-0.05cm}W) = \frac{ {\rm Pr}(W \hspace{-0.05cm}\mid \hspace{-0.05cm}L)\cdot {\rm Pr}(L) }{ {\rm Pr}(W \hspace{-0.05cm}\mid \hspace{-0.05cm}L) \cdot {\rm Pr}(L) +{\rm Pr}(W \hspace{-0.05cm}\mid \hspace{-0.05cm}T) \cdot {\rm Pr}(T)}=\rm \frac{0.6\cdot 0.7}{0.6\cdot 0.7 + 0.1\cdot 0.3}=\frac{14}{15}\approx 93.3 \%$$

- vorhersagen, dass sie an der LMU studieren wird. Ein durchaus realistisches Ergebnis (zumindest in der Vergangenheit).

Die Aussagen dieses Abschnitts sind im Lernvideo Statistische Abhängigkeit und Unabhängigkeit zusammengefasst.

Aufgaben zum Kapitel

Aufgabe 1.4: 2S/3E-Kanalmodell

Aufgabe 1.4Z: Summe von Ternärgrößen

Aufgabe 1.5Z: Ausfallwahrscheinlichkeiten