Digitalsignalübertragung/Struktur des optimalen Empfängers: Unterschied zwischen den Versionen

Ayush (Diskussion | Beiträge) (Die Seite wurde neu angelegt: „ {{Header |Untermenü=Verallgemeinerte Beschreibung digitaler Modulationsverfahren |Vorherige Seite=Signale, Basisfunktionen und Vektorräume |Nächste Seite=…“) |

Ayush (Diskussion | Beiträge) |

||

| Zeile 10: | Zeile 10: | ||

In diesem Kapitel wird die Struktur des optimalen Empfängers eines digitalen Übertragungssystems sehr allgemein hergeleitet, wobei | In diesem Kapitel wird die Struktur des optimalen Empfängers eines digitalen Übertragungssystems sehr allgemein hergeleitet, wobei | ||

*das Modulationsverfahren und weitere Systemdetails nicht weiter spezifiziert werden,<br> | *das Modulationsverfahren und weitere Systemdetails nicht weiter spezifiziert werden,<br> | ||

| − | *von den Basisfunktionen und der Signalraumdarstellung gemäß Kapitel 4.1 ausgegangen wird.. | + | *von den Basisfunktionen und der Signalraumdarstellung gemäß Kapitel 4.1 ausgegangen wird.. |

| − | [[Datei:P ID2000 Dig T 4 2 S1 version1.png|Allgemeines Blockschaltbild eines Kommunikationssystems|class=fit]]<br> | + | :[[Datei:P ID2000 Dig T 4 2 S1 version1.png|Allgemeines Blockschaltbild eines Kommunikationssystems|class=fit]]<br> |

Zum obigen Blockschaltbild ist anzumerken: | Zum obigen Blockschaltbild ist anzumerken: | ||

| Zeile 38: | Zeile 38: | ||

== Fundamentaler Ansatz zum optimalen Empfängerentwurf (1) == | == Fundamentaler Ansatz zum optimalen Empfängerentwurf (1) == | ||

<br> | <br> | ||

| − | Gegenüber dem auf der vorherigen Seite gezeigten Blockschaltbild führen wir nun einige wesentliche Verallgemeinerungen durch: | + | Gegenüber dem auf der vorherigen Seite gezeigten [http://www.lntwww.de/index.php?title=Digitalsignal%C3%BCbertragung/Struktur_des_optimalen_Empf%C3%A4ngers&action=submit#Blockschaltbild_und_Voraussetzungen Blockschaltbild] führen wir nun einige wesentliche Verallgemeinerungen durch: |

*Der Übertragungskanal wird durch die bedingte Wahrscheinlichkeitsdichtefunktion <i>p</i><sub><i>r</i>(<i>t</i>)|<i>s</i>(<i>t</i>)</sub> beschrieben, welche die Anhängigkeit des Empfangssignals <i>r</i>(<i>t</i>) vom Sendesignal <i>s</i>(<i>t</i>) festlegt.<br> | *Der Übertragungskanal wird durch die bedingte Wahrscheinlichkeitsdichtefunktion <i>p</i><sub><i>r</i>(<i>t</i>)|<i>s</i>(<i>t</i>)</sub> beschrieben, welche die Anhängigkeit des Empfangssignals <i>r</i>(<i>t</i>) vom Sendesignal <i>s</i>(<i>t</i>) festlegt.<br> | ||

| Zeile 65: | Zeile 65: | ||

Im Gegensatz zur oberen Gleichung tritt nun in der Entscheidungsregel eine bedingte Wahrscheinlichkeit <i>P</i><sub><i>m</i>|<b><i>r</i></b></sub> anstelle der bedingten Wahrscheinlichkeitskeitsdichtefunktion (WDF) <i>p</i><sub><i>m</i>|<i>r</i>(<i>t</i>)</sub> auf. Beachten Sie bitte die Groß– bzw. Kleinschreibung für die unterschiedlichen Bedeutungen.<br> | Im Gegensatz zur oberen Gleichung tritt nun in der Entscheidungsregel eine bedingte Wahrscheinlichkeit <i>P</i><sub><i>m</i>|<b><i>r</i></b></sub> anstelle der bedingten Wahrscheinlichkeitskeitsdichtefunktion (WDF) <i>p</i><sub><i>m</i>|<i>r</i>(<i>t</i>)</sub> auf. Beachten Sie bitte die Groß– bzw. Kleinschreibung für die unterschiedlichen Bedeutungen.<br> | ||

| + | |||

| + | == Fundamentaler Ansatz zum optimalen Empfängerentwurf (2) == | ||

| + | <br> | ||

| + | Wir betrachten nun die Funktion <i>y</i> = arg max <i>p</i>(<i>x</i>), wobei <i>p</i>(<i>x</i>) die Wahrscheinlichkeitsdichtefunktion (WDF) einer wertkontinuierlichen oder wertdiskreten Zufallsgröße <i>x</i> beschreibt. Im zweiten Fall besteht die WDF aus einer Summe von Diracfunktionen mit den Wahrscheinlichkeiten als Impulsgewichte.<br> | ||

| + | |||

| + | [[Datei:P ID2002 Dig T 4 2 S2b version1.png|Zur Verdeutlichung der Funktion „arg max”|class=fit]]<br> | ||

| + | |||

| + | Die Grafik zeigt beispielhafte Funktionen. In beiden Fällen liegt das WDF–Maximum (17) bei <i>x</i> = 6: | ||

| + | |||

| + | :<math>\max_i \hspace{0.1cm} p(x) = 17\hspace{0.05cm},\hspace{0.2cm}y = {\rm arg} \max_i \hspace{0.1cm} p(x) = 6\hspace{0.05cm}.</math> | ||

| + | |||

| + | Man nennt die (bedingten) Wahrscheinlichkeiten in der Gleichung | ||

| + | |||

| + | :<math>\hat{m} = {\rm arg} \max_i \hspace{0.1cm} P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho})</math> | ||

| + | |||

| + | auch a–Posteriori–Wahrscheinlichkeiten. Mit dem [http://www.lntwww.de/Stochastische_Signaltheorie/Statistische_Abh%C3%A4ngigkeit_und_Unabh%C3%A4ngigkeit#R.C3.BCckschlusswahrscheinlichkeit Satz] von Bayes kann hierfür geschrieben werden: | ||

| + | |||

| + | :<math>P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho}) = | ||

| + | \frac{{\rm Pr}( m_i) \cdot p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )}{p_{\boldsymbol{ r}} (\boldsymbol{\rho})} | ||

| + | \hspace{0.05cm}.</math> | ||

| + | |||

| + | Da der Term im Nenner für alle <i>m<sub>i</sub></i> gleich ist, muss er für die Entscheidung nicht weiter berücksichtigt werden. Damit erhält man die folgenden Regeln: | ||

| + | |||

| + | {{Satz}} '''1:''' Die Entscheidungsregel des optimalen Empfängers, auch bekannt als MAP–Empfänger (die Abkürzung steht für Maximum–a–posteriori), lautet: | ||

| + | |||

| + | :<math>\hat{m}_{\rm MAP} = {\rm arg} \max_i \hspace{0.1cm} P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho}) = {\rm arg} \max_i \hspace{0.1cm} [ {\rm Pr}( m_i) \cdot p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )]\hspace{0.05cm}.</math> | ||

| + | |||

| + | Der Vorteil dieser Gleichung ist, dass die die Vorwärtsrichtung des Kanals beschreibende bedingte WDF <i>p<sub><b>r</b>|m</sub></i> („Ausgang unter der Bedingung Eingang”) verwendet werden kann. Dagegen verwendet die erste Gleichung die Rückschlusswahrscheinlichkeiten <i>P</i><sub><i>m|<b>r</b></i></sub> („Eingang unter der Bedingung Ausgang”). | ||

| + | |||

| + | {{Satz}} <b>2:</b> Ein Maximum–Likelihood–Empfänger (ML–Empfänger) verwendet die Entscheidungsregel | ||

| + | |||

| + | :<math>\hat{m}_{\rm ML} = \hspace{-0.1cm} {\rm arg} \max_i \hspace{0.1cm} p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )\hspace{0.05cm}.</math> | ||

| + | |||

| + | Bei diesem werden die möglicherweise unterschiedlichen Auftrittswahrscheinlichkeiten Pr(<i>m<sub>i</sub></i>) für den Entscheidungsprozess nicht herangezogen, zum Beispiel, weil sie dem Empfänger nicht bekannt sind.{{end}}{{end}}<br> | ||

| + | |||

| + | <b>Hinweis:</b> Im Kapitel 3.7 finden Sie eine andere Herleitung. Allgemein gilt: Bei gleichwahrscheinlichen Nachrichten {<i>m<sub>i</sub></i>} ⇒ Pr(<i>m<sub>i</sub></i>) = 1/<i>M</i> ist der ML–Empfänger gleichwertig mit dem MAP–Empfänger: | ||

| + | |||

| + | :<math>\hat{m}_{\rm MAP} = \hat{m}_{\rm ML} =\hspace{-0.1cm} {\rm arg} \max_i \hspace{0.1cm} | ||

| + | p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )\hspace{0.05cm}.</math> | ||

| + | == == | ||

{{Display}} | {{Display}} | ||

Version vom 28. Dezember 2016, 12:56 Uhr

Inhaltsverzeichnis

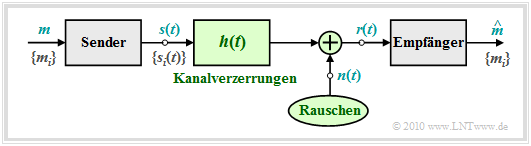

Blockschaltbild und Voraussetzungen

In diesem Kapitel wird die Struktur des optimalen Empfängers eines digitalen Übertragungssystems sehr allgemein hergeleitet, wobei

- das Modulationsverfahren und weitere Systemdetails nicht weiter spezifiziert werden,

- von den Basisfunktionen und der Signalraumdarstellung gemäß Kapitel 4.1 ausgegangen wird..

Zum obigen Blockschaltbild ist anzumerken:

- Der Symbolumfang der Quelle beträgt M und der Symbolvorrat ist {mi} mit i = 0, ... , M – 1. Die zugehörigen Symbolwahrscheinlichkeiten Pr(m = mi) seien auch dem Empfänger bekannt.

- Zur Nachrichtenübertragung stehen M verschiedene Signalformen si(t) zur Verfügung, wobei für die Laufvariable ebenfalls die Indizierung i = 0, ... , M – 1 gelten soll.

- Es besteht eine feste Beziehung zwischen den Nachrichten {mi} und den Signalen {si(t)}. Wird die Nachricht m = mi übertragen, so ist das Sendesignal s(t) = si(t).

- Lineare Kanalverzerrungen sind in der obigen Grafik durch die Impulsantwort h(t) berücksichtigt. Außerdem ist ein (irgendwie geartetes) Rauschen n(t) wirksam.

- Mit diesen beiden die Übertragung störenden Effekten lässt sich das am Empfänger ankommende Signal r(t) in folgender Weise angeben:

- \[r(t) = s(t) \star h(t) + n(t) \hspace{0.05cm}.\]

- Aufgabe des (optimalen) Empfängers ist es, anhand seines Eingangssignals r(t) herauszufinden, welche der M möglichen Nachrichten mi – bzw. welches der Signale si(t) – gesendet wurde.

- Der vom Empfänger gefundene Schätzwert für m wird in Gleichungen durch ein „Circonflexe” (^) gekennzeichnet. Im Fließtext (HTML–Zeichensatz) ist diese Darstellung leider nicht möglich.

- Man spricht von einem optimalen Empfänger, wenn die Symbolfehlerwahrscheinlichkeit den für die Randbedingungen kleinstmöglichsten Wert annimmt:

- \[p_{\rm S} = {\rm Pr} ({\cal E}) = {\rm Pr} ( \hat{m} \ne m) \hspace{0.15cm} \Rightarrow \hspace{0.15cm}{\rm Minimum} \hspace{0.05cm}.\]

Hinweis: Im Folgenden wird meist r(t) = s(t) + n(t) vorausgesetzt, was bedeutet, dass h(t) = δ(t) als verzerrungsfrei angenommen wird. Andernfalls könnten wir die Signale si(t) als s'i(t) = si(t) ∗ h(t) neu definieren, also die deterministischen Kanalverzerrungen dem Sendesignal beaufschlagen.

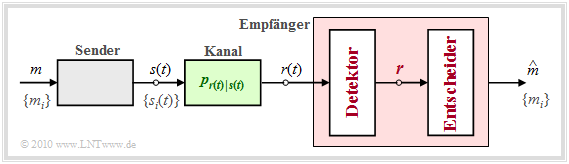

Fundamentaler Ansatz zum optimalen Empfängerentwurf (1)

Gegenüber dem auf der vorherigen Seite gezeigten Blockschaltbild führen wir nun einige wesentliche Verallgemeinerungen durch:

- Der Übertragungskanal wird durch die bedingte Wahrscheinlichkeitsdichtefunktion pr(t)|s(t) beschrieben, welche die Anhängigkeit des Empfangssignals r(t) vom Sendesignal s(t) festlegt.

- Wurde nun ein ganz bestimmtes Signal r(t) = ρ(t) empfangen, so hat der Empfänger die Aufgabe, anhand dieses Signals ρ(t) sowie der M bedingten Wahrscheinlichkeitsdichtefunktionen

- \[p_{r(t) | s(t) } (\rho(t) | s_i(t))\hspace{0.2cm}{\rm mit}\hspace{0.2cm} i = 0, ... \hspace{0.05cm}, M-1\]

- unter Berücksichtigung aller möglichen Sendesignale si(t) und deren Auftrittswahrscheinlichkeiten Pr(m = mi) herauszufinden, welche der möglichen Nachrichten (mi) bzw. welches der möglichen Signale (si(t)) am wahrscheinlichsten gesendet wurde.

- Die Schätzung des optimalen Empfängers ist also ganz allgemein bestimmt durch die Gleichung

- \[\hat{m} = {\rm arg} \max_i \hspace{0.1cm} p_{s(t) | r(t) } ( s_i(t) | \rho(t)) = {\rm arg} \max_i \hspace{0.1cm} p_{m | r(t) } ( m_i | \rho(t))\hspace{0.05cm},\]

- wobei wieder berücksichtigt ist, dass die gesendete Nachricht m = mi und das gesendete Signal s(t) = si(t) eineindeutig ineinander übergeführt werden können.

In anderen Worten: Der optimale Empfänger betrachtet diejenige Nachricht mi als die gesendete, wenn die bedingte Wahrscheinlichkeitsdichtefunktion pm|r(t) für das anliegende Empfangssignal ρ(t) sowie unter der Annahme m = mi den größtmöglichen Wert annimmt.

Bevor wir die obige Entscheidungsregel näher diskutieren, soll der optimale Empfänger entsprechend der Grafik noch in zwei Funktionsblöcke aufgeteilt werden:

- Der Detektor nimmt am Empfangssignal r(t) verschiedene Messungen vor und fasst diese im Vektor r zusammen. Bei K Messungen entspricht r einem Punkt im K–dimensionalen Vektorraum.

- Der Entscheider bildet abhängig von diesem Vektor den Schätzwert. Bei einem gegebenen Vektor r = ρ lautet dabei die Entscheidungsregel:

- \[\hat{m} = {\rm arg} \max_i \hspace{0.1cm} P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho}) \hspace{0.05cm}.\]

Im Gegensatz zur oberen Gleichung tritt nun in der Entscheidungsregel eine bedingte Wahrscheinlichkeit Pm|r anstelle der bedingten Wahrscheinlichkeitskeitsdichtefunktion (WDF) pm|r(t) auf. Beachten Sie bitte die Groß– bzw. Kleinschreibung für die unterschiedlichen Bedeutungen.

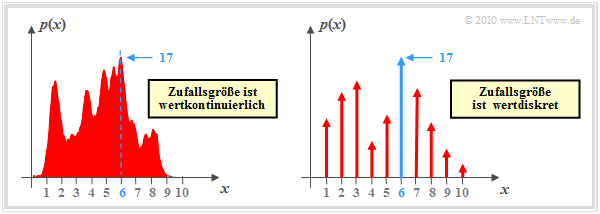

Fundamentaler Ansatz zum optimalen Empfängerentwurf (2)

Wir betrachten nun die Funktion y = arg max p(x), wobei p(x) die Wahrscheinlichkeitsdichtefunktion (WDF) einer wertkontinuierlichen oder wertdiskreten Zufallsgröße x beschreibt. Im zweiten Fall besteht die WDF aus einer Summe von Diracfunktionen mit den Wahrscheinlichkeiten als Impulsgewichte.

Die Grafik zeigt beispielhafte Funktionen. In beiden Fällen liegt das WDF–Maximum (17) bei x = 6:

\[\max_i \hspace{0.1cm} p(x) = 17\hspace{0.05cm},\hspace{0.2cm}y = {\rm arg} \max_i \hspace{0.1cm} p(x) = 6\hspace{0.05cm}.\]

Man nennt die (bedingten) Wahrscheinlichkeiten in der Gleichung

\[\hat{m} = {\rm arg} \max_i \hspace{0.1cm} P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho})\]

auch a–Posteriori–Wahrscheinlichkeiten. Mit dem Satz von Bayes kann hierfür geschrieben werden:

\[P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho}) = \frac{{\rm Pr}( m_i) \cdot p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )}{p_{\boldsymbol{ r}} (\boldsymbol{\rho})} \hspace{0.05cm}.\]

Da der Term im Nenner für alle mi gleich ist, muss er für die Entscheidung nicht weiter berücksichtigt werden. Damit erhält man die folgenden Regeln:

\[\hat{m}_{\rm MAP} = {\rm arg} \max_i \hspace{0.1cm} P_{m | \boldsymbol{ r} } ( m_i | \boldsymbol{\rho}) = {\rm arg} \max_i \hspace{0.1cm} [ {\rm Pr}( m_i) \cdot p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )]\hspace{0.05cm}.\]

Der Vorteil dieser Gleichung ist, dass die die Vorwärtsrichtung des Kanals beschreibende bedingte WDF pr|m („Ausgang unter der Bedingung Eingang”) verwendet werden kann. Dagegen verwendet die erste Gleichung die Rückschlusswahrscheinlichkeiten Pm|r („Eingang unter der Bedingung Ausgang”).

\[\hat{m}_{\rm ML} = \hspace{-0.1cm} {\rm arg} \max_i \hspace{0.1cm} p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )\hspace{0.05cm}.\]

Bei diesem werden die möglicherweise unterschiedlichen Auftrittswahrscheinlichkeiten Pr(mi) für den Entscheidungsprozess nicht herangezogen, zum Beispiel, weil sie dem Empfänger nicht bekannt sind.

Hinweis: Im Kapitel 3.7 finden Sie eine andere Herleitung. Allgemein gilt: Bei gleichwahrscheinlichen Nachrichten {mi} ⇒ Pr(mi) = 1/M ist der ML–Empfänger gleichwertig mit dem MAP–Empfänger:

\[\hat{m}_{\rm MAP} = \hat{m}_{\rm ML} =\hspace{-0.1cm} {\rm arg} \max_i \hspace{0.1cm} p_{\boldsymbol{ r}|m } (\boldsymbol{\rho}|m_i )\hspace{0.05cm}.\]