Aufgaben:Aufgabe 4.3: WDF–Vergleich bezüglich differentieller Entropie: Unterschied zwischen den Versionen

| Zeile 28: | Zeile 28: | ||

:$$h(X) = {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm A} \cdot A) | :$$h(X) = {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm A} \cdot A) | ||

\hspace{0.05cm},$$ | \hspace{0.05cm},$$ | ||

| − | *Unter der Nebenbedingung ${\rm E}[|X – m_1|^2] ≤ σ^2$ ⇒ [[Informationstheorie/Differentielle_Entropie#Beweis:_Maximale_differentielle_Entropie_bei_Leistungsbegrenzung|Leistungsbegrenzung]]: | + | *Unter der Nebenbedingung ${\rm E}\big [|X – m_1|^2 \big ] ≤ σ^2$ ⇒ [[Informationstheorie/Differentielle_Entropie#Beweis:_Maximale_differentielle_Entropie_bei_Leistungsbegrenzung|Leistungsbegrenzung]]: |

:$$h(X) = {1}/{2} \cdot {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm L} \cdot \sigma^2) | :$$h(X) = {1}/{2} \cdot {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm L} \cdot \sigma^2) | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| Zeile 91: | Zeile 91: | ||

A = \frac{1}{\sqrt{2\pi \sigma^2}}\hspace{0.05cm}.$$ | A = \frac{1}{\sqrt{2\pi \sigma^2}}\hspace{0.05cm}.$$ | ||

Logarithmiert man diese Funktion, so erhält man als Ergebnis den <u>Lösungsvorschlag 1</u>: | Logarithmiert man diese Funktion, so erhält man als Ergebnis den <u>Lösungsvorschlag 1</u>: | ||

| − | :$${\rm ln}\hspace{0.1cm} \ | + | :$${\rm ln}\hspace{0.1cm} \big [f_X(x) \big ] = {\rm ln}\hspace{0.1cm}(A) + |

{\rm ln}\hspace{0.1cm}\left [{\rm exp} ( | {\rm ln}\hspace{0.1cm}\left [{\rm exp} ( | ||

- \hspace{0.05cm}\frac{x ^2}{2 \sigma^2}) \right ] | - \hspace{0.05cm}\frac{x ^2}{2 \sigma^2}) \right ] | ||

= {\rm ln}\hspace{0.1cm}(A) - \frac{x ^2}{2 \sigma^2}\hspace{0.05cm}.$$ | = {\rm ln}\hspace{0.1cm}(A) - \frac{x ^2}{2 \sigma^2}\hspace{0.05cm}.$$ | ||

| − | '''(2)''' Mit | + | |

| + | '''(2)''' <u>Beide Lösungsvorschläge</u> sind richtig. | ||

| + | *Mit dem Ergebnis aus '''(1)''' erhält man für die differentielle Entropie in „nat”: | ||

:$$h_{\rm nat}(X)= -\hspace{-0.1cm} \int_{-\infty}^{+\infty} \hspace{-0.15cm} f_X(x) \cdot {\rm ln} \hspace{0.1cm} [f_X(x)] \hspace{0.1cm}{\rm d}x = | :$$h_{\rm nat}(X)= -\hspace{-0.1cm} \int_{-\infty}^{+\infty} \hspace{-0.15cm} f_X(x) \cdot {\rm ln} \hspace{0.1cm} [f_X(x)] \hspace{0.1cm}{\rm d}x = | ||

- {\rm ln}\hspace{0.1cm}(A) \cdot | - {\rm ln}\hspace{0.1cm}(A) \cdot | ||

| Zeile 102: | Zeile 104: | ||

+ \frac{1}{2 \sigma^2} \cdot \int_{-\infty}^{+\infty} \hspace{-0.15cm} x^2 \cdot f_X(x) \hspace{0.1cm}{\rm d}x = - {\rm ln}\hspace{0.1cm}(A) + {1}/{2} | + \frac{1}{2 \sigma^2} \cdot \int_{-\infty}^{+\infty} \hspace{-0.15cm} x^2 \cdot f_X(x) \hspace{0.1cm}{\rm d}x = - {\rm ln}\hspace{0.1cm}(A) + {1}/{2} | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| − | Hierbei ist berücksichtigt, dass das erste Integral gleich 1 ist (WDF–Fläche) und das zweite Integral gleich die Varianz | + | *Hierbei ist berücksichtigt, dass das erste Integral gleich $1$ ist (WDF–Fläche) und das zweite Integral gleich die Varianz $\sigma^2$ angibt (wenn wie hier der Gleichanteil $m_1 = = 0$ ist). |

| + | *Ersetzt man die Abkürzungsvariable $A$, so erhält man: | ||

:$$h_{\rm nat}(X) \hspace{-0.15cm} = \hspace{-0.15cm} - {\rm ln}\hspace{0.05cm}\left (\frac{1}{\sqrt{2\pi \sigma^2}} \right ) + {1}/{2} = {1}/{2}\cdot {\rm ln}\hspace{0.05cm}\left ({2\pi \sigma^2} \right ) + {1}/{2} \cdot {\rm ln}\hspace{0.05cm}\left ( {\rm e} \right ) = {1}/{2} \cdot {\rm ln}\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right ) | :$$h_{\rm nat}(X) \hspace{-0.15cm} = \hspace{-0.15cm} - {\rm ln}\hspace{0.05cm}\left (\frac{1}{\sqrt{2\pi \sigma^2}} \right ) + {1}/{2} = {1}/{2}\cdot {\rm ln}\hspace{0.05cm}\left ({2\pi \sigma^2} \right ) + {1}/{2} \cdot {\rm ln}\hspace{0.05cm}\left ( {\rm e} \right ) = {1}/{2} \cdot {\rm ln}\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right ) | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| − | Soll die differentielle Entropie | + | *Soll die differentielle Entropie $h(X)$ nicht in „nat” angegeben werden, sondern in „bit”, so ist für den Logarithmus die Basis 2 zu wählen: |

:$$h_{\rm bit}(X) = {1}/{2} \cdot {\rm log}_2\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right ) | :$$h_{\rm bit}(X) = {1}/{2} \cdot {\rm log}_2\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right ) | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| − | |||

| − | '''(3)''' Nach der impliziten Definition | + | '''(3)''' Nach der impliziten Definition $h(X) = {1}/{2} \cdot {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm L} \cdot \sigma^2)$ ergibt sich somit für die Kenngröße: |

:$${\it \Gamma}_{\rm L} = 2\pi {\rm e} \hspace{0.15cm}\underline{\approx 17.08} | :$${\it \Gamma}_{\rm L} = 2\pi {\rm e} \hspace{0.15cm}\underline{\approx 17.08} | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| − | '''(4)''' Wir betrachten nun eine Gaußsche Wahrscheinlichkeitsdichtefunktion mit Mittelwert | + | |

| + | '''(4)''' Wir betrachten nun eine Gaußsche Wahrscheinlichkeitsdichtefunktion mit Mittelwert $m_1$: | ||

:$$f_X(x) = \frac{1}{\sqrt{2\pi \sigma^2}} \cdot {\rm exp}\left [ | :$$f_X(x) = \frac{1}{\sqrt{2\pi \sigma^2}} \cdot {\rm exp}\left [ | ||

- \hspace{0.05cm}\frac{(x -m_1)^2}{2 \sigma^2} \right ] | - \hspace{0.05cm}\frac{(x -m_1)^2}{2 \sigma^2} \right ] | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| − | Das zweite Moment | + | * Das zweite Moment $m_2 = {\rm E}\big [X ^2 \big ]$ kann man auch als die Leistung $P$ bezeichnen, während für die Varianz gilt: $\sigma^2 = {\rm E}\big [|X – m_1|^2 \big ] = \mu_2$ (ist gleichzeitig das zweite Zentralmoment). |

| + | * Nach dem Satz von Steiner gilt $P = m_2 = m_1^2 + \sigma^2$. Unter der Voraussetzung $m_1 = \sigma = 1$ ist somit $\underline{P/\sigma^2 = 2}$. | ||

| − | Durch den Gleichanteil wird zwar die Leistung verdoppelt. An der differentiellen Entropie ändert sich dadurch aber nichts. Es gilt somit | + | *Durch den Gleichanteil wird zwar die Leistung verdoppelt. An der differentiellen Entropie ändert sich dadurch aber nichts. Es gilt somit weiterhin: |

| − | weiterhin: | ||

:$$h(X) = {1}/{2} \cdot {\rm log}_2\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right )= {1}/{2} \cdot {\rm log}_2\hspace{0.05cm} (17.08)\hspace{0.15cm}\underline{\approx 2.047\,{\rm bit}} | :$$h(X) = {1}/{2} \cdot {\rm log}_2\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right )= {1}/{2} \cdot {\rm log}_2\hspace{0.05cm} (17.08)\hspace{0.15cm}\underline{\approx 2.047\,{\rm bit}} | ||

\hspace{0.05cm}.$$ | \hspace{0.05cm}.$$ | ||

| Zeile 134: | Zeile 137: | ||

* Für die Gleichverteilung <i>f</i><sub>1</sub>(<i>x</i>) ist die Kenngröße <i>Γ</i><sub>L</sub> = 12 die kleinste in der gesamten Tabelle ⇒ der Lösungsvorschlag 2 ist falsch. | * Für die Gleichverteilung <i>f</i><sub>1</sub>(<i>x</i>) ist die Kenngröße <i>Γ</i><sub>L</sub> = 12 die kleinste in der gesamten Tabelle ⇒ der Lösungsvorschlag 2 ist falsch. | ||

* Die Dreieckverteilung <i>f</i><sub>2</sub>(<i>x</i>) ist mit <i>Γ</i><sub>L</sub> = 16.31 günstiger als die Gleichverteilung und auch besser als die Laplaceverteilung (<i>f</i><sub>3</sub>(<i>x</i>), <i>Γ</i><sub>L</sub> = 14.78) ⇒ auch der Lösungsvorschlag 3 ist falsch. | * Die Dreieckverteilung <i>f</i><sub>2</sub>(<i>x</i>) ist mit <i>Γ</i><sub>L</sub> = 16.31 günstiger als die Gleichverteilung und auch besser als die Laplaceverteilung (<i>f</i><sub>3</sub>(<i>x</i>), <i>Γ</i><sub>L</sub> = 14.78) ⇒ auch der Lösungsvorschlag 3 ist falsch. | ||

| + | |||

Version vom 16. Oktober 2018, 13:36 Uhr

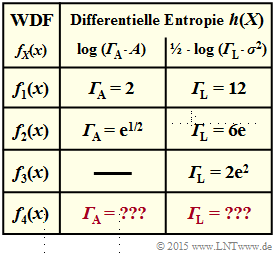

Nebenstehende Tabelle zeigt das Vergleichsergebnis hinsichtlich der differentiellen Entropie $h(X)$ für

- die Gleichverteilung ⇒ $f_X(x) = f_1(x)$:

- $$f_1(x) = \left\{ \begin{array}{c} 1/(2A) \\ 0 \\ \end{array} \right. \begin{array}{*{20}c} {\rm{f\ddot{u}r}} \hspace{0.1cm} |x| \le A \\ {\rm sonst} \\ \end{array} ,$$

- die Dreieckverteilung ⇒ $f_X(x) = f_2(x)$:

- $$f_2(x) = \left\{ \begin{array}{c} 1/A \cdot \big [1 - |x|/A \big ] \\ 0 \\ \end{array} \right. \begin{array}{*{20}c} {\rm{f\ddot{u}r}} \hspace{0.1cm} |x| \le A \\ {\rm sonst} \\ \end{array} ,$$

- die Laplaceverteilung ⇒ $f_X(x) = f_3(x)$:

- $$f_3(x) = \lambda/2 \cdot {\rm e}^{-\lambda \hspace{0.05cm} \cdot \hspace{0.05cm}|x|}\hspace{0.05cm}.$$

Die Werte für die Gaußverteilung ⇒ $f_X(x) = f_4(x)$ mit

- $$f_4(x) = \frac{1}{\sqrt{2\pi \sigma^2}} \cdot {\rm e}^{ - \hspace{0.05cm}{x ^2}/{(2 \sigma^2})}$$

sind hier noch nicht eingetragen. Diese sollen in den Teilaufgaben (1) bis (3) ermittelt werden.

Alle hier betrachteten Wahrscheinlichkeitsdichtefunktionen sind

- symmetrisch um $x = 0$ ⇒ $f_X(-x) = f_X(x)$

- und damit mittelwertfrei ⇒ $m_1 = 0$.

In allen hier betrachteten Fällen kann die differentielle Entropie wie folgt dargestellt werden:

- Unter der Nebenbedingung $|X| ≤ A$ ⇒ Spitzenwertbegrenzung:

- $$h(X) = {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm A} \cdot A) \hspace{0.05cm},$$

- Unter der Nebenbedingung ${\rm E}\big [|X – m_1|^2 \big ] ≤ σ^2$ ⇒ Leistungsbegrenzung:

- $$h(X) = {1}/{2} \cdot {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm L} \cdot \sigma^2) \hspace{0.05cm}.$$

Je größer die jeweilige Kenngröße ${\it \Gamma}_{\hspace{-0.05cm}\rm A}$ bzw. ${\it \Gamma}_{\hspace{-0.05cm}\rm L}$ ist, desto günstiger ist bei der vereinbarten Nebenbedingung die vorliegende WDF hinsichtlich der differentiellen Entropie.

Hinweise:

- Die Aufgabe gehört zum Kapitel Differentielle Entropie.

- Nützliche Hinweise zur Lösung dieser Aufgabe finden Sie insbesondere auf den Seiten

Fragebogen

Musterlösung

- $$f_X(x) = f_4(x) =A \cdot {\rm exp} [ - \hspace{0.05cm}\frac{x ^2}{2 \sigma^2}] \hspace{0.5cm}{\rm mit}\hspace{0.5cm} A = \frac{1}{\sqrt{2\pi \sigma^2}}\hspace{0.05cm}.$$

Logarithmiert man diese Funktion, so erhält man als Ergebnis den Lösungsvorschlag 1:

- $${\rm ln}\hspace{0.1cm} \big [f_X(x) \big ] = {\rm ln}\hspace{0.1cm}(A) + {\rm ln}\hspace{0.1cm}\left [{\rm exp} ( - \hspace{0.05cm}\frac{x ^2}{2 \sigma^2}) \right ] = {\rm ln}\hspace{0.1cm}(A) - \frac{x ^2}{2 \sigma^2}\hspace{0.05cm}.$$

(2) Beide Lösungsvorschläge sind richtig.

- Mit dem Ergebnis aus (1) erhält man für die differentielle Entropie in „nat”:

- $$h_{\rm nat}(X)= -\hspace{-0.1cm} \int_{-\infty}^{+\infty} \hspace{-0.15cm} f_X(x) \cdot {\rm ln} \hspace{0.1cm} [f_X(x)] \hspace{0.1cm}{\rm d}x = - {\rm ln}\hspace{0.1cm}(A) \cdot \int_{-\infty}^{+\infty} \hspace{-0.15cm} f_X(x) \hspace{0.1cm}{\rm d}x + \frac{1}{2 \sigma^2} \cdot \int_{-\infty}^{+\infty} \hspace{-0.15cm} x^2 \cdot f_X(x) \hspace{0.1cm}{\rm d}x = - {\rm ln}\hspace{0.1cm}(A) + {1}/{2} \hspace{0.05cm}.$$

- Hierbei ist berücksichtigt, dass das erste Integral gleich $1$ ist (WDF–Fläche) und das zweite Integral gleich die Varianz $\sigma^2$ angibt (wenn wie hier der Gleichanteil $m_1 = = 0$ ist).

- Ersetzt man die Abkürzungsvariable $A$, so erhält man:

- $$h_{\rm nat}(X) \hspace{-0.15cm} = \hspace{-0.15cm} - {\rm ln}\hspace{0.05cm}\left (\frac{1}{\sqrt{2\pi \sigma^2}} \right ) + {1}/{2} = {1}/{2}\cdot {\rm ln}\hspace{0.05cm}\left ({2\pi \sigma^2} \right ) + {1}/{2} \cdot {\rm ln}\hspace{0.05cm}\left ( {\rm e} \right ) = {1}/{2} \cdot {\rm ln}\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right ) \hspace{0.05cm}.$$

- Soll die differentielle Entropie $h(X)$ nicht in „nat” angegeben werden, sondern in „bit”, so ist für den Logarithmus die Basis 2 zu wählen:

- $$h_{\rm bit}(X) = {1}/{2} \cdot {\rm log}_2\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right ) \hspace{0.05cm}.$$

(3) Nach der impliziten Definition $h(X) = {1}/{2} \cdot {\rm log} \hspace{0.1cm} ({\it \Gamma}_{\hspace{-0.05cm}\rm L} \cdot \sigma^2)$ ergibt sich somit für die Kenngröße:

- $${\it \Gamma}_{\rm L} = 2\pi {\rm e} \hspace{0.15cm}\underline{\approx 17.08} \hspace{0.05cm}.$$

(4) Wir betrachten nun eine Gaußsche Wahrscheinlichkeitsdichtefunktion mit Mittelwert $m_1$:

- $$f_X(x) = \frac{1}{\sqrt{2\pi \sigma^2}} \cdot {\rm exp}\left [ - \hspace{0.05cm}\frac{(x -m_1)^2}{2 \sigma^2} \right ] \hspace{0.05cm}.$$

- Das zweite Moment $m_2 = {\rm E}\big [X ^2 \big ]$ kann man auch als die Leistung $P$ bezeichnen, während für die Varianz gilt: $\sigma^2 = {\rm E}\big [|X – m_1|^2 \big ] = \mu_2$ (ist gleichzeitig das zweite Zentralmoment).

- Nach dem Satz von Steiner gilt $P = m_2 = m_1^2 + \sigma^2$. Unter der Voraussetzung $m_1 = \sigma = 1$ ist somit $\underline{P/\sigma^2 = 2}$.

- Durch den Gleichanteil wird zwar die Leistung verdoppelt. An der differentiellen Entropie ändert sich dadurch aber nichts. Es gilt somit weiterhin:

- $$h(X) = {1}/{2} \cdot {\rm log}_2\hspace{0.05cm}\left ({{2\pi {\rm e} \cdot \sigma^2}} \right )= {1}/{2} \cdot {\rm log}_2\hspace{0.05cm} (17.08)\hspace{0.15cm}\underline{\approx 2.047\,{\rm bit}} \hspace{0.05cm}.$$

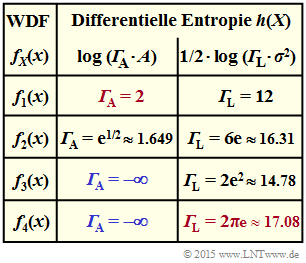

(5) In der vervollständigten Tabelle sind auch die numerischen Werte der Kenngrößen ΓL und ΓA eingetragen.

Eine Wahrscheinlichkeitsdichtefunktion fX(x) ist bei Leistungsbegrenzung immer dann besonders günstig, wenn der Wert ΓL (rechte Spalte) möglichst groß ist. Dann ist die differentielle Entropie h(X) ebenfalls groß. Die numerischen Ergebnisse lassen sich wie folgt interpretieren:

- Wie imTheorieteil bewiesen wird, führt die Gaußverteilung f4(x) hier zum größtmöglichen ΓL ≈ 17.08 ⇒ Lösungsvorschlag 1 ist richtig (Wert in der letzten Spalte rot markiert).

- Für die Gleichverteilung f1(x) ist die Kenngröße ΓL = 12 die kleinste in der gesamten Tabelle ⇒ der Lösungsvorschlag 2 ist falsch.

- Die Dreieckverteilung f2(x) ist mit ΓL = 16.31 günstiger als die Gleichverteilung und auch besser als die Laplaceverteilung (f3(x), ΓL = 14.78) ⇒ auch der Lösungsvorschlag 3 ist falsch.

(6) Eine WDF fX(x) ist unter der Nebenbedingung der Spitzenwertbegrenzung ⇒ |X| ≤ A günstig hinsichtlich der differentiellen Entropie h(X), wenn der Bewertungsfaktor ΓA (mittlere Spalte) möglichst groß ist:

- Wie im Theorieteil gezeigt wird, führt die Gleichverteilung f1(x) hier zum größtmöglichen ΓA = 2 ⇒ der Lösungsvorschlag 2 ist richtig (Wert in der mittleren Spalte rot markiert).

- Die ebenfalls spitzenwertbegrenzte Dreieckverteilung f2(x) ist durch ein etwas kleineres ΓA = 1.649 gekennzeichnet ⇒ der Lösungsvorschlag 3 ist falsch.

- Die Gaußverteilung f4(x) ist unendlich weit ausgedehnt. Eine Spitzenwertbegrenzung auf |X| ≤ A führt hier zu Diracfunktionen in der WDF ⇒ h(X) = –∞, siehe Musterlösung zur Zusatzaufgabe 4.2Z, Teilaufgabe (4).

- Gleiches würde auch für die Laplaceverteilung f3(x) gelten.