Fehlerwahrscheinlichkeit und Anwendungsgebiete

Blockfehlerwahrscheinlichkeit für RSC und BDD

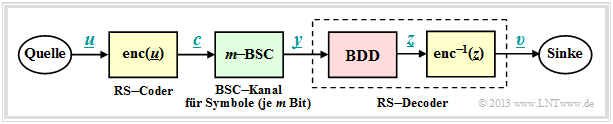

Zur Fehlerwahrscheinlichkeitsberechnung gehen wir vom gleichen Blockschaltbild wie im Kapitel 2.5 aus, wobei wir uns hier für den Codewortschätzer (y → z) auf Bounded Distance Decoding (BDD) beschränken. Für Maximum Likelihood Decoding sind die Ergebnisse geringfügig besser.

Die Blockfehlerwahrscheinlichkeit sei wie folgt definiert:

\[{ \rm Pr(Blockfehler)} = { \rm Pr}( \underline{\upsilon} \ne \underline{u})= { \rm Pr}( \underline{z} \ne \underline{c}) = { \rm Pr}( f >t) \hspace{0.05cm}.\]

Aufgrund der BDD–Annahme ergibt sich das gleiche einfache Ergebnis wie für die binären Blockcodes, nämlich die Wahrscheinlichkeit, dass die Anzahl f der Fehler im Block (Empfangswort) größer ist als die Korrekturfähigkeit t des Codes. Da für die Zufallsgröße f (Fehleranzahl) eine Binominalverteilung im Bereich 0 ≤ f ≤ n vorliegt, erhält man:

\[{\rm Pr(Blockfehler)} = \sum_{f = t + 1}^{n} {n \choose f} \cdot {\varepsilon_{\rm S}}^f \cdot (1 - \varepsilon_{\rm S})^{n-f} \hspace{0.05cm}.\]

Während aber im Kapitel 1 stets ci ∈ GF(2) gegolten hat und damit die f Übertragungsfehler jeweils Bitfehler waren, versteht man bei Reed–Solomon–Codierung unter einem Übertragungsfehler (yi ≠ ci) wegen ci ∈ GF(2m) bzw. yi ∈ GF(2m) einen Symbolfehler. Damit ergeben sich folgende Unterschiede:

- Das diskrete Kanalmodell zur Beschreibung der binären Blockcodes ist der Binary Symmetric Channel (BSC). Jedes Bit ci eines Codewortes wird mit der Wahrscheinlichkeit ε verfälscht (yi ≠ ci) und mit der Wahrscheinlichkeit 1 – ε richtig übertragen (yi = ci).

- Bei Reed–Solomon–Codierung muss das BSC–Modell durch das m–BSC–Kanalmodell ersetzt werden. Ein Symbol ci wird mit der Wahrscheinlichkeit εS in ein anderes Symbol yi verfälscht (egal, in welches) und kommt mit der Wahrscheinlichkeit 1 – εS unverfälscht beim Empfänger an.

\[1 - \varepsilon_{\rm S} = (1 - \varepsilon)^m = 0.9^8 \approx 0.43 \hspace{0.05cm}.\]

Damit ergibt sich für das 8–BSC–Modell die Verfälschungswahrscheinlichkeit εS ≈ 0.57. Mit der Annahme, dass die Verfälschung von ci = β in jedes andere Symbol yi = γ ≠ β gleichwahrscheinlich ist, erhält man Pr(yi = γ | ci = β) = 0.57/255 ≈ 0.223%.

Anwendung der Reed–Solomon–Codierung bei binären Kanälen (1)

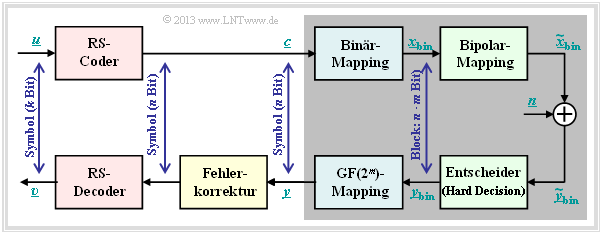

Die Voraussetzungen für die folgende Berechnung der Blockfehlerwahrscheinlichkeit eines Systems mit Reed–Solomon–Codierung und Umsetzung auf Binärsymbole sind in der Grafik zusammenge-fasst:

- Angenommen wird eine (n, k)–Reed–Solomon–Codierung mit Symbolen aus GF(2m). Je kleiner die Coderate R = k/n ist, um so weniger Information kann bei fester Datenrate übertragen werden.

- Jedes Symbol wird durch m Bit binär dargestellt ⇒ Binär–Mapping. Ein Block (Codewort c) besteht somit aus n Symbolen bzw. aus n · m Binärzeichen (Bit), die in cbin zusammengefasst sind.

- Vorausgesetzt wird außerdem der AWGN–Kanal, gekennzeichnet durch den Parameter EB/N0. Entsprechend diesem Kanalmodell geschieht die Übertragung bipolar: „0” ↔ „+1”, „1” ↔ „–1”.

- Der Empfänger trifft harte Entscheidungen (Hard Decision) auf Bitebene. Vor der Decodierung inclusive der Fehlerkorrektur werden die Binärsymbole wieder auf GF(2m)–Symbole umgesetzt.

Die auf der letzten Seite angegebene Gleichung (gültig für Bounded Distance Decoding),

\[{\rm Pr(Blockfehler)} = \sum_{f = t + 1}^{n} {n \choose f} \cdot {\varepsilon_{\rm S}}^f \cdot (1 - \varepsilon_{\rm S})^{n-f} \hspace{0.05cm},\]

basiert auf dem m–BSC–Kanal. Ausgehend vom AWGN–Kanal kommt man

- mit dem komplementären Gaußschen Fehlerintegral Q(x) zum BSC–Parameter

- \[\varepsilon = {\rm Q} \big (\sqrt{2 \cdot E_{\rm S}/N_0} \big ) = {\rm Q} \big (\sqrt{2 \cdot R \cdot E_{\rm B}/N_0} \big ) \hspace{0.05cm},\]

- und daraus zur Verfälschungswahrscheinlichkeit εS auf Symbolebene:

- \[\varepsilon_{\rm S} = 1 - (1 - \varepsilon)^m \hspace{0.05cm}.\]

\[\varepsilon = {\rm Q} \big (\sqrt{2 \cdot 0.9373 \cdot 5} \big ) = {\rm Q} \big (3.06\big ) \approx 1.1 \cdot 10^{-3} \hspace{0.05cm}\]

\[\Rightarrow\hspace{0.3cm} \varepsilon_{\rm S} = 1 - (1 - 1.1 \cdot 10^{-3})^8 = 1 - 0.9989^8 = 1 - 0.9912 \approx 0.88 \cdot 10^{-2} \hspace{0.05cm}.\]

Jedes einzelne Symbol wird also mit mehr als 99–prozentiger Wahrscheinlichkeit fehlerfrei übertragen.